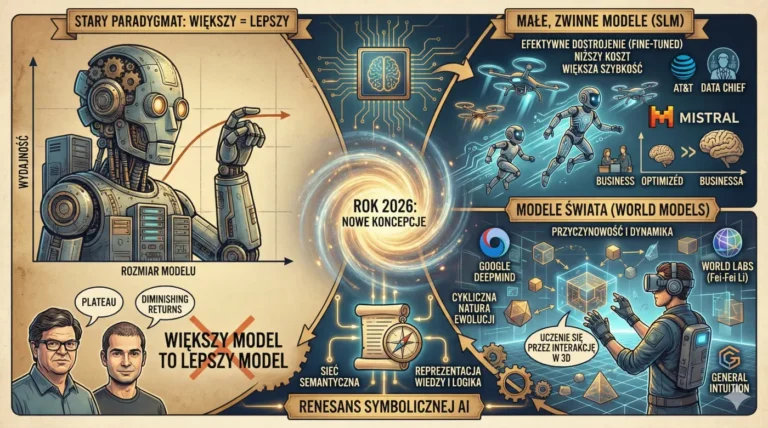

AI News dla UEK Tydzień #14 (4 – 10 kwietnia 2026) Era Multimodalnego Rozumowania i Cyfrowych Super-Aplikacji

Artykuł w formie audio czytany głosem lektora – treść wygenerowana z pomocą AIstudio.

Czas trwania: 4min 30sek.

⚡ Szybki Przegląd tygodnia:

Skonsolidowana wizja: Super-aplikacja OpenAI i Meta Muse Spark

Miniony tydzień w świecie sztucznej inteligencji upłynął pod znakiem konsolidacji możliwości i nowych, ambitnych projektów infrastrukturalnych. Najgorętszym tematem okazały się doniesienia o nowym kierunku rozwoju OpenAI, które pod wodzą Grega Brockmana dąży do stworzenia „Super-aplikacji AI”. Ma to być jeden, zintegrowany hub łączący ChatGPT, możliwości kodowania Codexu, zaawansowane przeglądanie sieci oraz autonomiczne agenty realizujące zadania w tle. To strategiczny ruch mający na celu stworzenie kompletnego cyfrowego ekosystemu, który wykracza poza zwykły czat.

Równolegle, Meta zaprezentowała Muse Spark – swój najnowszy, flagowy model dedykowany multimodalnemu rozumowaniu. Rozwijany w elitarnym Superintelligence Lab, ma rzucać wyzwanie najlepszym systemom od OpenAI i Anthropic w dziedzinach tak wymagających jak medycyna, fizyka teoretyczna czy zaawansowana matematyka. Model ten promuje koncepcję „contemplating mode”, pozwalającą na głębszą analizę odpowiedzi i redukcję halucynacji.

Regulacyjny przełom: FTC i portabilność modeli AI

Na froncie regulacyjnym tydzień przyniósł przełomowe wieści. Amerykańska Federalna Komisja Handlu (FTC) wydała orzeczenie nakazujące największym dostawcom (tzw. SIAMs) zapewnienie pełnej interoperacyjności i portabilności modeli. Oznacza to, że użytkownicy będą mogli łatwiej przenosić swoje fine-tuned data między chmurami. Tymczasem w Unii Europejskiej Parlament przegłosował Digital Omnibus, który przesuwa terminy wdrożenia najbardziej restrykcyjnych wymogów dotyczących systemów AI „wysokiego ryzyka” na koniec 2027 roku.

Polska na mapie AI: Konferencja we Wrocławiu

W Polsce najważniejszym wydarzeniem akademickim była 5. edycja konferencji „Philosophy in Technology” we Wrocławiu, gdzie polscy uczeni debatowali nad filozoficznymi fundamentami sztucznej inteligencji i jej wpływem na cyfrowy humanizm. Pozwala to naszej rodzimej nauce zachować podmiotowość w globalnej debacie o etyce algorytmów.

🚀 1. Radar Technologiczny

„AI Super-app” – Jak OpenAI dąży do zintegrowanego ekosystemu

Radar technologiczny w tym tygodniu został całkowicie zdominowany przez dwa gigantyczne ogłoszenia. Pierwszym z nich jest wizja „Super-aplikacji” od OpenAI. Według raportów, firma dostrzegła, że rozproszenie narzędzi ogranicza produktywność użytkowników profesjonalnych. Nowa platforma ma być fundamentem pod „Intelligence Age”, gdzie AI przechodzi metamorfozę z prostego narzędzia w autonomicznego współpracownika zintegrowanego bezpośrednio z systemem operacyjnym. Integracja ta ma pozwolić agentom OpenAI na wykonywanie skomplikowanych operacji na plikach, zarządzanie kalendarzami czy automatyczne debugowanie kodu. To fundamentalna zmiana paradygmatu – przeniesienie akcentu z „AI jako czatu” na „AI jako cyfrowego pracownika”.

Meta Muse Spark – Nowa era multimodalności w służbie nauki

Drugim kluczowym punktem jest premiera Muse Spark od Meta. Model ten, zbudowany od podstaw przez Superintelligence Labs kierowane przez Alexandra Wanga, wyróżnia się natywną multimodalnością. W przeciwieństwie do systemów scalających oddzielne komponenty wizyjne, Muse Spark przetwarza obrazy, dźwięk i tekst w jednej, ujednoliconej architekturze neuronowej. Pozwala to na rozumowanie nad diagramami medycznymi, nagraniami z wykładów czy dokumentacją techniczną z niespotykaną dotąd precyzją. Meta chwali się, że model osiągnął rekordowe wyniki w testach logic planning, co czyni go idealnym kandydatem do automatyzacji procesów badawczych na uczelniach takich jak UEK.

Wyścig zbrojeń: Anthropic i miliardowe inwestycje w infrastrukturę

Warto również odnotować strategiczny ruch Anthropic, który podpisał umowę z Google i Broadcom na dostarczenie infrastruktury o mocy 3,5 GW. Budowanie modeli przyszłej generacji wymaga zasobów energetycznych porównywalnych z potrzebami dużych miast. Anthropic planuje wykorzystać tę moc do trenowania linii Claude 5, skupiającej się na bezpieczeństwie i etycznym rozumowaniu. To jasny sygnał dla rynku: wartość ekonomiczna w świecie AI przenosi się z software’u na unikalny dostęp do mocy obliczeniowej i wysokiej jakości danych treningowych, co potwierdza ostatnia inwestycja Mety w Scale AI wartą 14 miliardów dolarów. Skok w kierunku AI agentowej, która „rozumie i działa”, jest najważniejszym trendem kwietnia 2026 roku.

🎓 2. Akademia i Administracja w Praktyce

OpenAI Safety Fellowship – Szansa dla badaczy z UEK

Świat nauki i administracji uczelnianej otrzymał silne wsparcie od sektora komercyjnego. OpenAI ogłosiło uruchomienie Safety Fellowship – prestiżowego programu stypendialnego oferującego granty w wysokości 100 tysięcy dolarów oraz aż milion dolarów w kredytach na API. Program ma na celu wsparcie badaczy podejmujących temat technicznych aspektów kontroli modeli AI. Dla naukowców z Uniwersytetu Ekonomicznego w Krakowie to doskonała okazja, by włączyć się w nurt badań nad bezpieczeństwem systemów autonomicznych. Podejście OpenAI – „otwartych drzwi, ale zamkniętych serwerów” – staje się nowym standardem w relacjach Big Tech z akademią, promując przejrzystość bez narażania własności intelektualnej.

Filozofia w murach Wrocławia – Jak etyka kształtuje innowacje

Blisko naszych granic rozpoczęła się 5. edycja konferencji „Philosophy in Technology” na Politechnice Wrocławskiej. Wydarzenie to stało się centrum polskiej myśli nad humanocentryczną sztuczną inteligencją. Dyskusje koncentrują się na wpływie automatyzacji na tożsamość człowieka oraz roli filozofii w projektowaniu algorytmów decyzyjnych. Wnioski z Wrocławia są kluczowe dla administracji UEK: technologia to przede wszystkim system wartości. Polska nauka pokazuje, że mamy istotny głos w debacie o cyfrowym humanizmie, a wypracowane tam tezy mogą stać się fundamentem pod przyszłe wytyczne dotyczące wdrożeń AI na poziomie ministerialnym.

Bezpieczeństwo najmłodszych: OpenAI Child Safety Blueprint

Kolejnym praktycznym krokiem jest publikacja Child Safety Blueprint przez OpenAI. To kompleksowy zbiór wytycznych mających na celu ochronę nieletnich przed zagrożeniami takimi jak manipulacja algorytmiczna czy generowanie szkodliwych treści. Mechanizmy tam opisane – takie jak wielowarstwowa moderacja czy filtry intencyjne – są bezpośrednio aplikowalne w tworzeniu bezpiecznych instancji ChatGPT dla administracji uczelni czy w budowaniu asystentów naukowych dla studentów. Dokument ten, poparty przez organizacje takie jak NCMEC, stanowi wiarygodny drogowskaz w budowaniu „bezpiecznej szkoły wyższej” w dobie wszechobecnych algorytmów.

💰 3. Biznes, Ekonomia, Etyka i Prawo

Reakcja FTC: Koniec „zamkniętych ogrodów” dla gigantów AI

W obszarze biznesu i prawa tydzień ten przejdzie do historii jako moment walki z dominacją rynkową gigantów. Amerykańska Federalna Komisja Handlu (FTC) wydała przełomowe orzeczenie wprowadzające pozycję „Systemically Important AI Models” (SIAMs). Dostawcy tych modeli zostali zobligowani do wdrożenia standardów interoperacyjności i portabilności. W praktyce oznacza to, że korporacje finansowe czy uczelnie muszą mieć możliwość bezproblemowego wyeksportowania swoich fine-tuning data i przeniesienia ich do konkurencji bez utraty funkcjonalności. FTC traktuje modele AI jako infrastrukturę krytyczną. Dla nas na UEK to szansa na uniknięcie zjawiska „vendor lock-in”, co zwiększa nasze bezpieczeństwo strategiczne i elastyczność inwestycyjną.

Unijny Digital Omnibus – Złapanie oddechu przed EU AI Act

Równolegle w Europie, Parlament Europejski przegłosował Digital Omnibus, przesuwając termin pełnej zgodności dla systemów „wysokiego ryzyka” na 2 grudnia 2027 r.. Głosowanie (stosunkiem 569 głosów za) to dowód na pragmatyzm Brukseli – regulatorzy zrozumieli, że budowa infrastruktury zaufania wymaga czasu na certyfikację. Dla przedsiębiorców współpracujących z UEK to „oddech” pozwalający na przeprowadzenie rzetelnych audytów. Należy jednak pamiętać, że wymogi dotyczące przejrzystości (oznaczanie AI-generated content) wchodzą w życie bez zmian, co zmusza do ciągłej weryfikacji materiałów egzaminacyjnych.

Inwestycyjny gigant: Meta przejmuje udziały w Scale AI

Nie możemy pominąć inwestycji Mety – 14,3 miliarda dolarów za przejęcie 49% udziałów w Scale AI. To jasna deklaracja: w 2026 roku paliwem potęgi są „czyste” i zweryfikowane dane. Ruch ten, połączony z przywództwem Alexandra Wanga w Superintelligence Labs, pokazuje, że budowana jest struktura zdolna do rywalizacji na poziomie infrastrukturalnym. Dla studentów ekonomii na UEK to przykład integracji pionowej. Obserwujemy narodziny oligopolu surowcowego, gdzie kilka firm kontroluje algorytmy, energię i dane. To wyzwanie dla prawa antymonopolowego, które musi zdefiniować granice sprawiedliwości społecznej w świecie zdominowanym przez „prawdę cyfrową”.

🚀 4. Przegląd Naukowy i Wydarzenia

Z.ai GLM-5.1 – Otwarty kolos bije rekordy kodowania

W świecie open-source tydzień należy do firmy Z.ai, która rzuciła rękawicę zamkniętym modelom. Ich model GLM-5.1 to kolos o architekturze Mixture-of-Experts (MoE), posiadający 754 miliardy parametrów. Został on zoptymalizowany pod kątem „agentic engineering”. W benchmarku SWE-Bench Pro zdobył oszałamiające 58,4 punktu, wyprzedzając GPT-5.4 czy Claude Opus 4.6. Najważniejsze: model udostępniono na licencji MIT. Naukowcy z UEK mogą pobrać jego wagi i uruchomić je na lokalnych serwerach, dostosowując do potrzeb analizy ekonometrycznej. To kamień milowy w demokratyzacji technologii klasy superintelligence.

Demokratyzacja agentów: Rodzina „Stral” i projekt Goose

Społeczność wydała gamę narzędzi z rodziny „Stral”: Magistral (rozumowanie matematyczne), Pixtral (multimodalna wizja) oraz Devstral (agenci kodujący). Te projekty pokazują koniec ery „jednego modelu do wszystkiego”. Ciekawa jest inicjatywa Agentic AI Foundation, której przekazano model Goose – otwartoźródłowy silnik do budowy agentów w systemach ERP i CRM. Dla badaczy zarządzania to poligon doświadczalny: jak wprowadzenie agentów wpłynie na efektywność organizacji? Badania nad orkiestracją pracy ludzi i botów będą kluczowym tematem nadchodzącego semestru.

Pułapki RESI – Czy AI zacznie kopiować własne błędy?

Zwracamy uwagę na postęp w Recursive Self-Improvement (RESI) – mechanizmie generowania własnych danych treningowych. Przecieki rynkowe sugerują, że Llama 5 będzie korzystać z tych technik, by przełamać barierę „data wall”. Budzi to pytania socjologiczne: czy AI karmiąca się własną twórczością nie doprowadzi do degeneracji modelu? Czy przetrwamy w świecie, gdzie 90% wiedzy jest generowane przez algorytmy? Te zagadnienia pokazują, że technologia rozwija się szybciej niż nasza zdolność do jej opisu, a modele open-source są jedynym sposobem na zachowanie kontroli nad kierunkiem tej rewolucji.

🎯 5. Podsumowanie Tygodnia

Tydzień 4-10 kwietnia 2026 r. to moment, w którym AI zaczęła „pakować walizki” i wychodzić z okienek czatowych wprost do serca naszych procesów prawnych i prawnych. Konsolidacja OpenAI w super-aplikację to sygnał, że nadchodzi czas AI wykonawczej. Dla społeczności UEK oznacza to adaptację do nowej roli: z użytkowników stajemy się kuratorami procesów algorytmicznych.

Najważniejszą lekcją jest potęga interoperacyjności. Orzeczenie FTC to zwycięstwo wolności cyfrowej. Jednocześnie Digital Omnibus daje nam cenny czas na mądrą reformę procedur dydaktycznych. Synergia gigantów i ruchu open-source tworzy dynamiczny balans. Dla Uniwersytetu Ekonomicznego w Krakowie wyzwaniem pozostaje odróżnienie szumu od realnych narzędzi budujących wartość naukową. Wrocławskie debaty przypominają: w tym wyścigu liczą się nie tylko GPU, ale przede wszystkim serce i rozum.

🔗 6. Skarbnica Wiedzy

- OpenAI Industrial Policy for the Intelligence Age – Oficjalny manifest OpenAI promujący pro-ludzką politykę przemysłową i wsparcie dla badaczy bezpieczeństwa. LINK

- Z.ai GLM-5.1 Release Blog – Szczegółowy opis techniczny i benchmarki nowego, otwartego kolosa o architekturze MoE, który bije rekordy w kodowaniu. LINK

- Meta Muse Spark Announcement – Prezentacja nowego modelu multimodalnego rozumowania i opis działania Superintelligence Lab. LINK

- FTC Ruling on AI Interoperability – Szczegóły przełomowego orzeczenia amerykańskiego regulatora w sprawie przenoszenia modeli między platformami. LINK

- Child Safety blueprint OpenAI – Praktyczny przewodnik i ramy bezpieczeństwa dla ochrony najmłodszych użytkowników w dobie systemów generatywnych. LINK

- OpenAI Safety Fellowship Pilot – Informacje o nowym programie grantowym dla naukowców zajmujących się bezpieczeństwem i wyrównywaniem celów AI (AI alignment). LINK

📖 7. Bibliografia (APA 7)

- Anthropic. (2026, April 7). Anthropic expands compute partnership with Google and Broadcom to scale Claude 5. TechCrunch. https://techcrunch.com/2026/04/07/anthropic-compute-deal-google-broadcom-tpus/

- European Parliament. (2026, April 7). European Parliament votes to adopt Digital Omnibus, pushing high-risk AI deadlines to 2027. LinkedIn Policy Pulse. https://linkedin.com/pulse/ai-regulation-april-2026-what-you-need-know-vinnie-fisher-em60f

- Federal Trade Commission (FTC). (2026, April 8). Breaking the walled garden: FTC mandates AI interoperability for systemically important models. Financial Content Markets. https://markets.financialcontent.com/stocks/article/marketminute-2026-4-8-breaking-the-walled-garden-ftc-mandates-ai-interoperability-for-tech-giants

- Meta AI. (2026, April 8). Introducing Muse Spark: A multimodal reasoning model from Meta’s Superintelligence Lab. Meta AI Blog. https://ai.meta.com/blog/introducing-muse-spark-msl/

- OpenAI. (2026, April 6). Industrial policy for the intelligence age. OpenAI Official. https://openai.com/index/industrial-policy-for-the-intelligence-age/

- OpenAI. (2026, April 8). Introducing the child safety blueprint: A framework for protecting minors in AI. OpenAI Official. https://openai.com/index/introducing-child-safety-blueprint/

- Wrocław University of Science and Technology. (2026, April 10). 5th Philosophy in Technology Conference: Ethics, agency, and AI. PhilEvents. https://philevents.org/event/show/145905

- Z.ai. (2026, April 7). GLM-5.1: An open-source 754B parameter MoE model for agentic engineering. Z.ai Research Blog. https://z.ai/blog/glm-5.1

🎙️ 8. Posłuchaj lub Obejrzyj

Interesujesz się zagadnieniami tego odcinka, a masz przed sobą zadanie, przy którym wolisz posłuchać głosu, czy zerknąć tylko kątem oka? Ożywiamy suche fakty! Skorzystaj z przygotowanych multimedialnych form podania treści.

Podsumowanie Audio

Wersja podcastowa dla słuchawkowców – dwóch hostów AI dyskutuje o nowych „super-aplikacjach” i o tym, czy za rok będziemy jeszcze w ogóle pisać e-maile ręcznie. Rozmowa 2 hostów.

Artykuł czytany przez lektora:

Pełne ponad 4-minutowe nagranie treści artykułu dla osób będących w ruchu.

Podsumowanie wideo

Krótki, 3-minutowy briefing wizualny prezentujący Muse Spark w akcji oraz kluczowe tezy z wrocławskiej konferencji.

Prezentacja czyli slide deck do pobrania

Zestawienie tabelaryczne nowych regulacji FTC i UE – idealne do szybkiego przejrzenia na laptopie.

Po otwarciu PDF w aplikacji Adobe Reader naciśnij klawisze Ctr-L (tryb pełnoekranowy) i przechodź do kolejnych slajdów za pomocą strzałki w prawo.

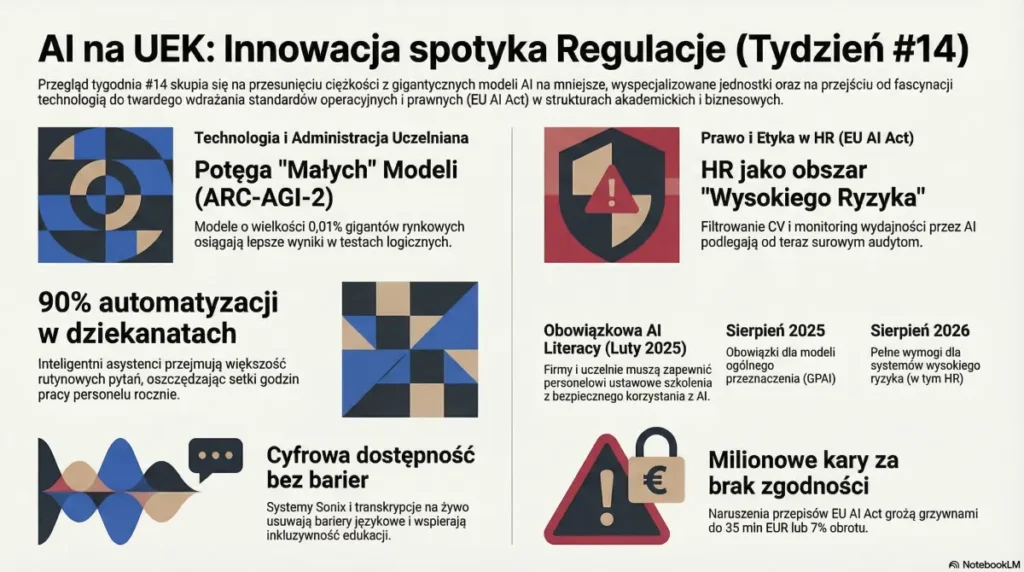

Infografika

Wstawiona INFOgrafika podsumowująca parametry modelu GLM-5.1 na tle konkurencji.

Uwaga

Badanie: 9 kwietnia 2026 r.

Narzędzia: Gemini, NotebookLM, AIstudio, Antigravity.

Grafiki: Google Imagen 3 (Vertex AI) – Styl UEK Modern Tech.