Wprowadzenie: Od Hype’u do Pragmatyzmu – Era Praktycznych Zastosowań AI

Rok 2026 stanowi punkt zwrotny w ewolucji sztucznej inteligencji, wyznaczając przejście od ery fascynacji i „hype’u” wokół wielkoskalowych modeli językowych do etapu pragmatycznych, ukierunkowanych wdrożeń. Czas eksperymentów dobiega końca; branża technologiczna zaczyna podchodzić do AI z większą dojrzałością, koncentrując się na realnej użyteczności, integracji z istniejącymi procesami i badaniu nowych, bardziej efektywnych architektur. Dla liderów akademickich, naukowców i studentów ta zmiana paradygmatu ma fundamentalne znaczenie. Dyskusje nieuchronnie przesuwają się od teoretycznych możliwości do operacyjnej rzeczywistości: jak AI wpłynie na alokację budżetów, transformację kadr, efektywność operacyjną, procesy badawcze i codzienne metody nauczania. Zrozumienie strategicznych implikacji tych zmian staje się kluczowe dla zachowania konkurencyjności i adekwatności instytucji szkolnictwa wyższego w nadchodzącej dekadzie.

1. Strategiczne Implikacje dla Uczelni: Wnioski dla Zarządzających

Strategiczne podejście do sztucznej inteligencji przestało być opcją – stało się operacyjną koniecznością. Jak wynika z analizy „5 AI Trends Universities Can’t Ignore in 2026„, decyzje podejmowane w tym roku zdefiniują pozycję konkurencyjną, efektywność operacyjną i zdolność instytucji do przyciągania talentów w nadchodzącej dekadzie. Ignorowanie tych trendów wiąże się z wymiernymi kosztami, podczas gdy świadome działanie wymaga zintegrowanego i przemyślanego planowania.

1.1. Alokacja Budżetu i Presja Inwestycyjna

Wyzwania budżetowe związane z wdrażaniem AI stają się coraz bardziej palące. Jak wskazuje raport Scholaro Research, większość uczelni nadal nie stworzyła dedykowanych linii budżetowych na sztuczną inteligencję. Koszty te są absorbowane przez istniejące kategorie, takie jak IT, licencje na oprogramowanie czy rozwój zawodowy, co znacząco utrudnia śledzenie rzeczywistych wydatków i uniemożliwia strategiczne planowanie.

Główne kategorie kosztów, z którymi muszą mierzyć się instytucje, obejmują:

- Wzrost cen licencji na oprogramowanie: Dostawcy tacy jak Microsoft, Google czy Adobe włączają funkcje AI do swoich produktów, podnosząc jednocześnie ceny subskrypcji.

- Inwestycje w infrastrukturę: Rosnące zapotrzebowanie na moc obliczeniową, przechowywanie danych i zaawansowane zabezpieczenia generuje dodatkowe obciążenia.

- Szkolenia i rozwój zawodowy kadr: Adaptacja pracowników i wykładowców do nowych narzędzi wymaga ciągłych inwestycji w ich kompetencje.

- Kontrakty z dostawcami wyspecjalizowanych narzędzi AI: Zakup dedykowanych rozwiązań stanowi kolejną, rosnącą pozycję w budżecie.

Przykładem poważnego zaangażowania jest Uniwersytet Stony Brook, który przeznaczył 15 milionów dolarów na ogólnouczelnianą inicjatywę AI. Mimo że kwota ta jest znacząca, władze uczelni podkreślają, że w kontekście skali transformacji jest ona jednocześnie skromna.

Z drugiej strony, AI oferuje potencjał redukcji kosztów. Chatboty wdrożone na Georgia State University i Arizona State University obsługują setki tysięcy zapytań studentów rocznie, odciążając personel administracyjny. Analizy przewidują, że UC Berkeley może zaoszczędzić od 5 do 10 milionów dolarów rocznie dzięki automatyzacji odpowiedzi na zapytania administracyjne. Należy jednak pamiętać, że zwrot z inwestycji (ROI) w AI jest kalkulacją wieloletnią. Koszty wdrożenia często przewyższają oszczędności w pierwszym roku, a realne korzyści finansowe mogą pojawić się dopiero po trzech lub czterech latach.

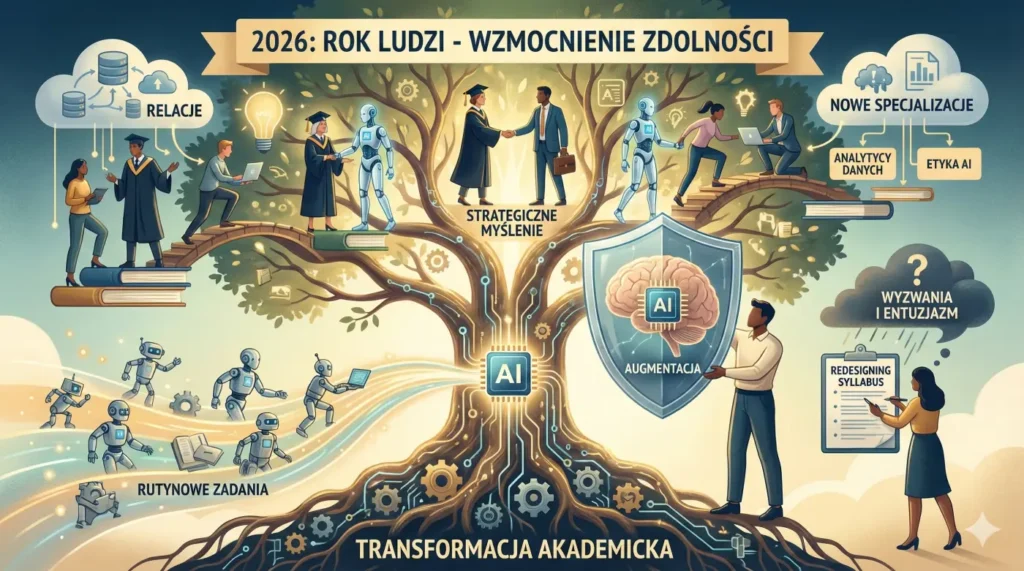

1.2. Transformacja Kadr i Nowe Wymagania Kompetencyjne

Sztuczna inteligencja nie eliminuje masowo stanowisk na uczelniach, ale fundamentalnie zmienia ich charakter i wymagania kompetencyjne. Dane z Educause wskazują, że 56% profesjonalistów w szkolnictwie wyższym ma już nowe obowiązki związane z AI. AI przejmuje zadania rutynowe i oparte na regułach (np. wstępna selekcja aplikacji, odpowiadanie na często zadawane pytania), co pozwala pracownikom skupić się na budowaniu relacji, złożonym rozwiązywaniu problemów i strategicznym myśleniu. Jednocześnie rośnie zapotrzebowanie na nowe specjalizacje, takie jak analitycy danych, specjaliści ds. AI czy koordynatorzy ds. etyki AI.

Ta transformacja nie jest jednak pozbawiona wyzwań. Raport AAUP alarmuje, że 76% badanych pracowników akademickich stwierdziło, że wdrożenie AI pogorszyło ich entuzjazm do pracy. Wykładowcy muszą uczyć się nowych narzędzi, przeprojektowywać metody oceny i integrować wiedzę o AI z programami nauczania, co często odbywa się bez dodatkowego czasu czy wynagrodzenia. Potwierdza to tezę z analizy TechCrunch, że 2026 to „rok ludzi” – kluczowe staje się wspieranie pracowników poprzez strategiczne przekwalifikowanie i postrzeganie AI jako narzędzia do augmentacji (wzmacniania) ludzkich zdolności, a nie ich pełnej automatyzacji.

1.3. Automatyzacja Operacji i Cykl Życia Studenta

AI automatyzuje procesy na uczelniach na każdym etapie cyklu życia studenta, od rekrutacji po ukończenie studiów. Narzędzia te nie tylko zwiększają efektywność operacyjną – szacunki KPMG wskazują na redukcję czasu poświęcanego na zadania administracyjne nawet o 80% – ale również podnoszą oczekiwania studentów, którzy przyzwyczajają się do natychmiastowych i spersonalizowanych usług.

| Obszar | Przykłady Zastosowań AI |

| Rekrutacja | Chatboty do obsługi kandydatów (np. Ivy.ai na Temple University), analityka predykcyjna prognozująca, którzy kandydaci najprawdopodobniej zapiszą się na studia, automatyzacja planowania spotkań. |

| Doradztwo i Wsparcie Studenta | Systemy wczesnego ostrzegania identyfikujące studentów zagrożonych rezygnacją, spersonalizowani tutorzy AI (jak na University of Toronto) odpowiadający na pytania dotyczące materiałów kursowych. |

| Operacje Biznesowe | Zautomatyzowane przetwarzanie faktur, wniosków o pomoc finansową i innych dokumentów, optymalizacja planów zajęć w oparciu o zapotrzebowanie i dostępność zasobów. |

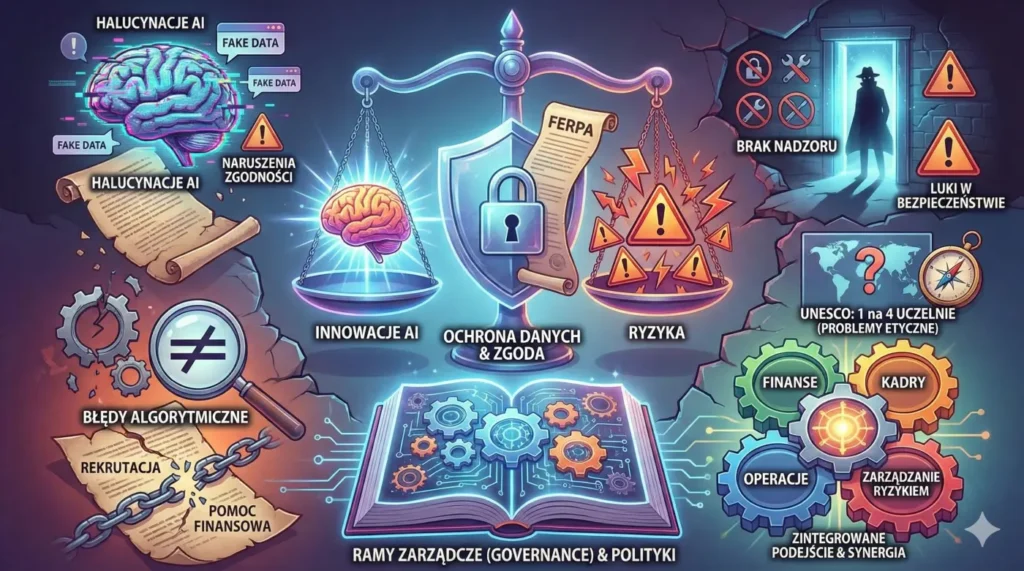

1.4. Zarządzanie Ryzykiem, Prywatność Danych i Nadzór

Wdrożenie AI niesie ze sobą nie tylko korzyści, ale również szereg ryzyk, które wymagają starannego zarządzania. Przetwarzanie danych studentów przez narzędzia AI podlega ścisłym regulacjom, takim jak amerykańska ustawa FERPA, co wymaga minimalizacji danych i zapewnienia zgody na ich wykorzystanie. Główne zagrożenia obejmują:

- „Halucynacje” AI: Generowanie fałszywych informacji, które w przypadku danych studentów mogą prowadzić do naruszeń zgodności.

- Błędy algorytmiczne: Stosowanie tendencyjnych algorytmów w procesach rekrutacji lub przyznawania pomocy finansowej może narazić uczelnię na straty wizerunkowe i prawne.

- Brak nadzoru: Pracownicy i wykładowcy często wdrażają narzędzia AI bez wiedzy i nadzoru działów IT, co tworzy luki w bezpieczeństwie.

Według danych UNESCO, co czwarta uczelnia na świecie napotkała już problemy etyczne związane z AI. Zarządzanie ryzykiem nie powinno jednak powstrzymywać przed innowacjami. Jest to natomiast sygnał, że wdrażanie AI musi iść w parze z tworzeniem przemyślanych ram zarządczych (governance) i polityk wewnętrznych.

Skuteczne zarządzanie AI na uczelni wymaga zintegrowanego podejścia, łączącego finanse, kadry, operacje i zarządzanie ryzykiem. Tylko taka synergia pozwoli w pełni wykorzystać potencjał technologii, jednocześnie minimalizując związane z nią zagrożenia.

2. Nowe Horyzonty w Badaniach i Rozwoju AI

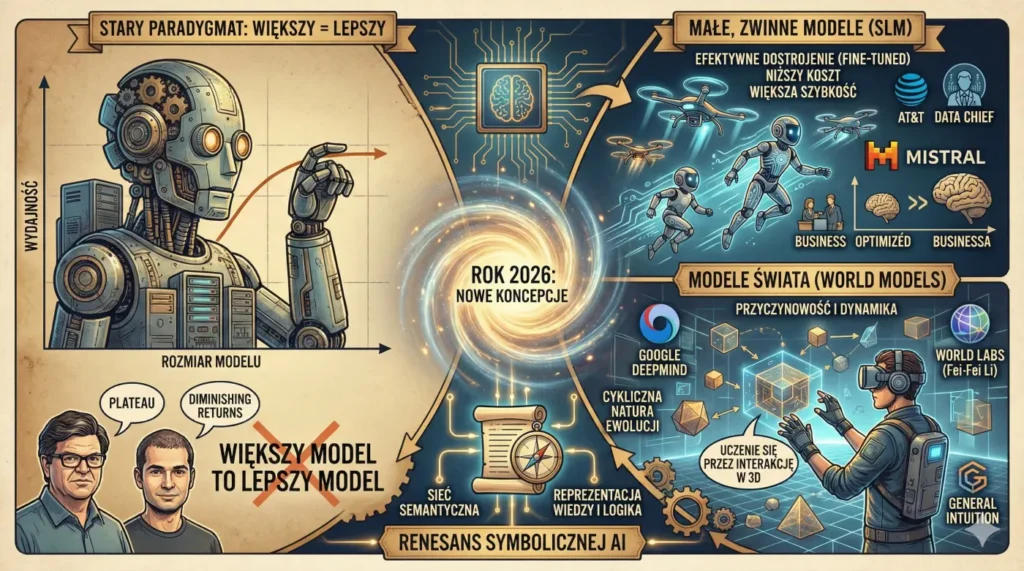

Równolegle do wdrożeń operacyjnych na uczelniach, w świecie badań nad sztuczną inteligencją zachodzi fundamentalna zmiana paradygmatu. Jak wskazuje TechCrunch, kończy się era oparta na przekonaniu, że jedyną drogą do postępu jest bezwzględne skalowanie modeli („brute-force scaling”). W 2026 roku naukowcy i inżynierowie coraz intensywniej poszukują nowych, bardziej efektywnych i wyspecjalizowanych architektur. Ta zmiana otwiera zupełnie nowe możliwości badawcze i kierunki rozwoju dla całej dziedziny.

2.1. Przesunięcie Paradygmatu: Od Skalowania do Nowych Architektur

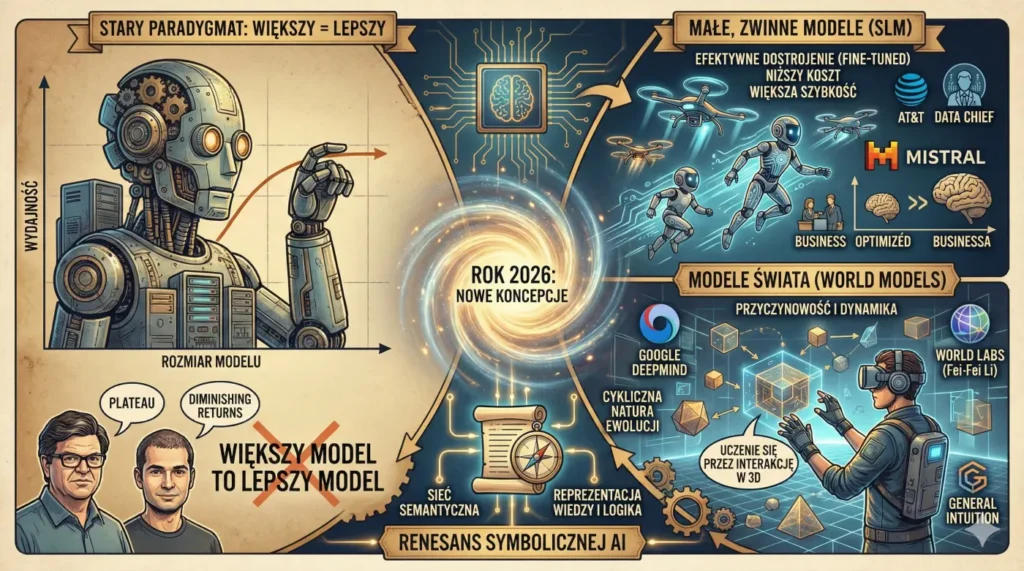

Dominująca przez lata teza, że „większy model to lepszy model”, zaczyna być kwestionowana przez czołowych badaczy. Autorytety takie jak Yann LeCun i Ilya Sutskever publicznie przyznają, że obecne modele osiągają pewne plateau, a dalsze zwiększanie ich rozmiaru nie przynosi już proporcjonalnych korzyści. W odpowiedzi na te wyzwania, w 2026 roku na znaczeniu zyskują nowe koncepcje:

- Małe, zwinne modele językowe (SLM): Eksperci, w tym dyrektor ds. danych w AT&T, wskazują, że odpowiednio dostrojone (fine-tuned) SLM-y mogą dorównywać dokładnością dużym, ogólnym modelom w zastosowaniach biznesowych, oferując jednocześnie znacznie niższy koszt i większą szybkość. Strategia firm takich jak Mistral opiera się właśnie na tej przewadze.

- Modele świata (World Models): To kolejny potencjalny przełom. W przeciwieństwie do LLM, które uczą się na podstawie tekstu, modele świata uczą się poprzez interakcję w wirtualnych przestrzeniach 3D, co pozwala im na głębsze rozumienie przyczynowości i dynamiki otoczenia. Inicjatywy takie jak Google DeepMind, World Labs Fei-Fei Li czy start-up General Intuition intensywnie rozwijają tę technologię.

Co ciekawe, ten zwrot w kierunku modeli rozumujących świat i autonomicznych agentów stanowi swoiste echo wcześniejszych, symbolicznych fal AI. Koncepcje takie jak Sieć Semantyczna (Semantic Web), które koncentrowały się na reprezentacji wiedzy i logice, przeżywają renesans w nowej formie, dowodząc cyklicznej natury ewolucji w dziedzinie sztucznej inteligencji.

2.2. Narodziny Ery Agentów: Od Koncepcji do Praktyki

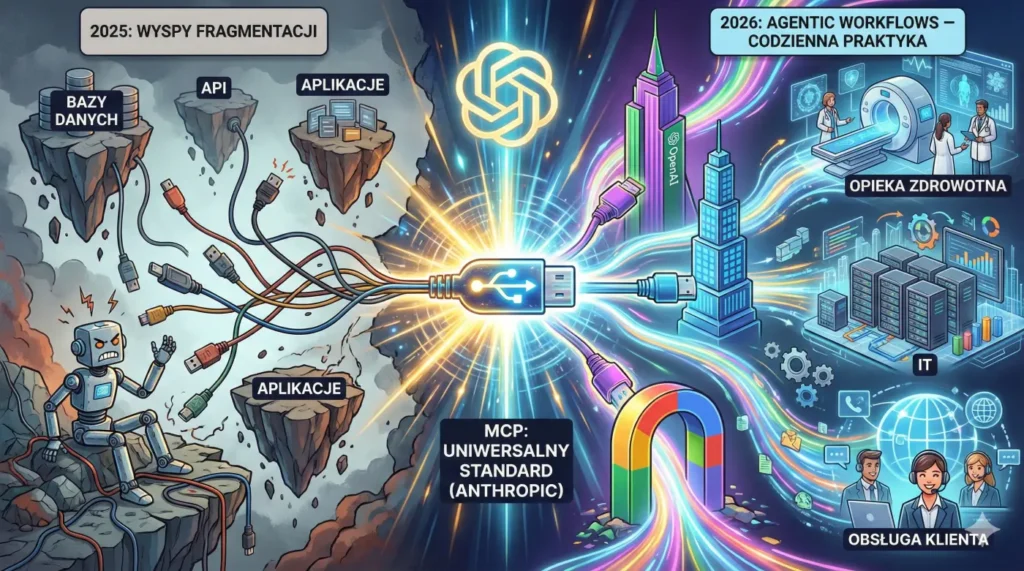

Rok 2025 nie spełnił pokładanych w agentach AI nadziei, głównie z powodu trudności w integracji z realnymi systemami (bazami danych, API, aplikacjami). Brakowało standardu, który umożliwiłby im płynną komunikację z cyfrowym światem. W 2026 roku ten problem zostaje rozwiązany dzięki Model Context Protocol (MCP), stworzonemu przez firmę Anthropic.

MCP działa jak „USB-C dla AI”, tworząc uniwersalny interfejs komunikacyjny dla agentów. Szybka adopcja tego standardu przez gigantów takich jak OpenAI, Microsoft i Google sprawia, że bariery technologiczne znikają. Dzięki temu w 2026 roku tzw. „agentic workflows” (przepływy pracy oparte na agentach) przechodzą z fazy demonstracji do codziennej praktyki w obszarach takich jak obsługa klienta, IT czy opieka zdrowotna, automatyzując wieloetapowe i złożone zadania.

2.3. Najnowsze Publikacje Naukowe (Styczeń 2026)

Pierwsze dni 2026 roku przyniosły szereg publikacji naukowych, które mogą mieć bezpośrednie znaczenie dla środowiska akademickiego. Oto wybrane z nich:

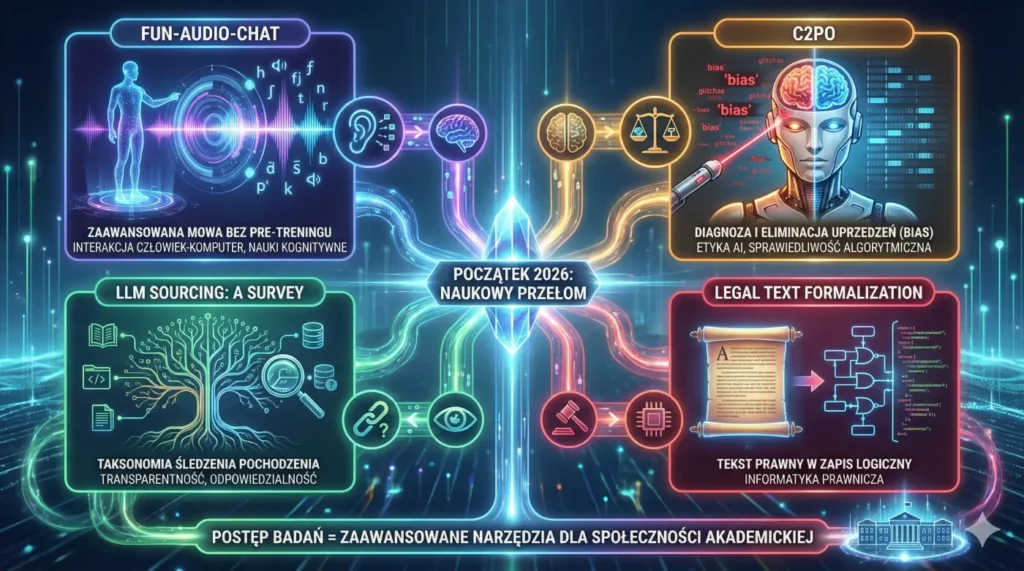

- Fun-Audio-Chat: Raport techniczny opisujący duży audio-model językowy, który umożliwia zaawansowane rozumienie i generowanie mowy bez potrzeby kosztownego pre-treningu na ogromnych zbiorach danych. Technologia ta ma duży potencjał w badaniach nad interakcją człowiek-komputer i w naukach kognitywnych.

- C2PO: Praca przedstawiająca nowatorską metodę diagnozowania i eliminowania uprzedzeń (bias) w rozumowaniu modeli językowych. Badania te są kluczowe z perspektywy etyki AI, nauk społecznych i zapewniania sprawiedliwości algorytmicznej.

- Large Language Model Sourcing: A Survey: Publikacja przeglądowa, która tworzy taksonomię metod śledzenia pochodzenia zachowań modeli AI. Stanowi ona kluczowe źródło dla naukowców zajmujących się transparentnością, odpowiedzialnością i wiarygodnością sztucznej inteligencji.

- Toward Robust Legal Text Formalization…: Artykuł będący przykładem praktycznego zastosowania LLM do przekształcania tekstów prawnych w formalny, logiczny zapis. Ma to szczególne znaczenie dla wydziałów prawa i kierunków związanych z informatyką prawniczą.

Postęp w badaniach podstawowych bezpośrednio przekłada się na rosnącą liczbę zaawansowanych i praktycznych narzędzi dostępnych dla całej społeczności akademickiej.

3. Zastosowania i Narzędzia AI w Praktyce Akademickiej

Teoretyczne postępy w dziedzinie AI błyskawicznie materializują się w postaci konkretnych narzędzi, które zmieniają metody pracy, nauki i badań. Ostatnie dni przyniosły przykłady rozwiązań, które mogą być natychmiast zaadaptowane przez studentów, wykładowców i naukowców, demonstrując praktyczny wymiar rewolucji AI.

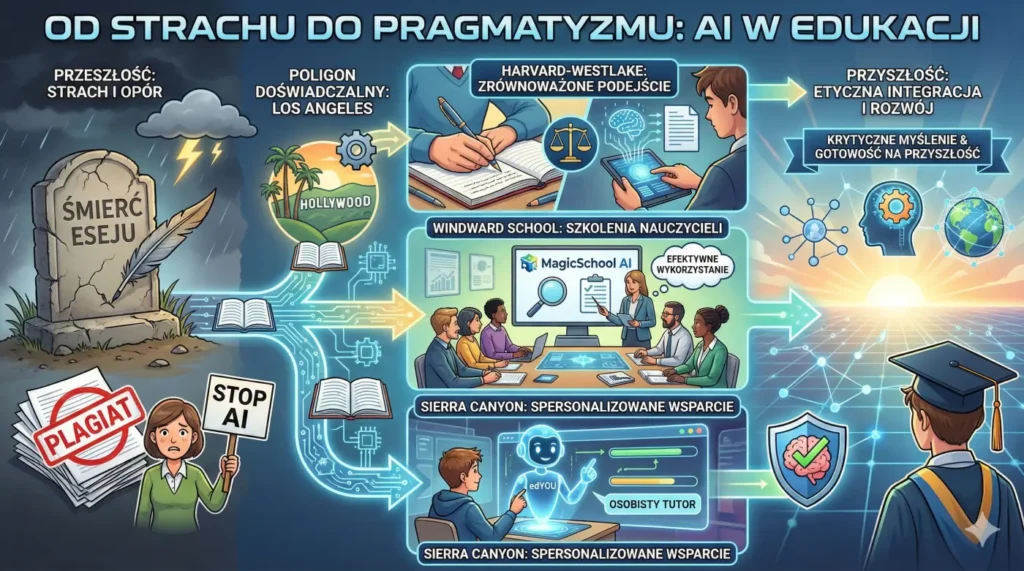

3.1. AI w Nauczaniu i Uczeniu się: Od Paniki do Pragmatyzmu

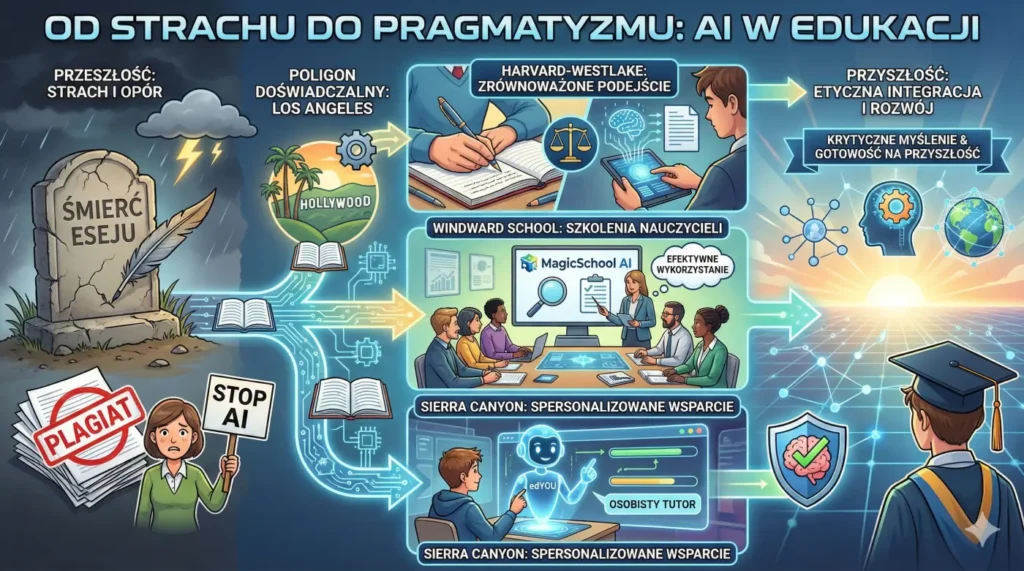

Początkowy strach przed AI w edukacji, symbolizowany przez hasła o „śmierci eseju” i masowych plagiatach, ustępuje miejsca dojrzałemu i pragmatycznemu podejściu. Prestiżowe prywatne szkoły w Los Angeles, takie jak Harvard-Westlake czy Sierra Canyon, stają się poligonem doświadczalnym dla zrównoważonej integracji AI w procesie nauczania. Kluczem nie jest zakazywanie, lecz mądre wykorzystanie narzędzi do wzmacniania nauki i przygotowania uczniów do przyszłości.

Przykłady z tych placówek obejmują:

- Zrównoważone podejście: Łączenie tradycyjnego pisania w klasie z kontrolowanym użyciem narzędzi AI do researchu i redakcji (Harvard-Westlake).

- Szkolenia dla nauczycieli: Programy rozwojowe koncentrujące się na efektywnym wykorzystaniu ChatGPT i specjalistycznych platform, jak MagicSchool AI (Windward School).

- Spersonalizowane wsparcie: Wdrażanie dedykowanych chatbotów, takich jak edYOU, które działają jako spersonalizowani tutorzy dla uczniów (Sierra Canyon).

Te inicjatywy pokazują, że celem staje się etyczna integracja AI, która rozwija umiejętności krytycznego myślenia i przygotowuje studentów do funkcjonowania w świecie, w którym AI jest wszechobecne.

3.2. Narzędzia Zwiększające Produktywność

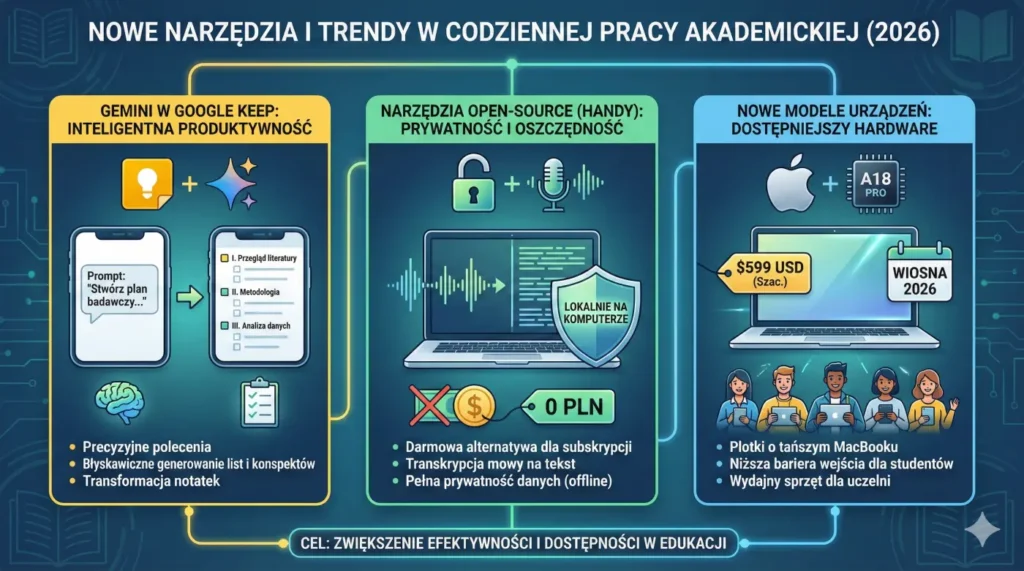

Nowe funkcje i narzędzia pojawiające się na rynku mają bezpośrednie zastosowanie w codziennej pracy akademickiej:

- Gemini w Google Keep: Integracja modelu Gemini przekształca prostą aplikację do notatek w potężne narzędzie produktywności. Za pomocą precyzyjnych poleceń (np. „Stwórz listę zakupów na tydzień dla dwóch osób na diecie śródziemnomorskiej o wysokiej zawartości białka, z budżetem 100 dolarów”) można błyskawicznie generować ustrukturyzowane listy, plany badawcze czy konspekty.

- Narzędzia Open-Source: Jako alternatywa dla drogich subskrypcji, społeczność open-source oferuje darmowe i skuteczne rozwiązania. Przykładem jest Handy – narzędzie do transkrypcji mowy na tekst, które działa lokalnie na komputerze, zapewniając prywatność i eliminując koszty.

- Nowe modele urządzeń: Na horyzoncie pojawiają się plotki o tańszym MacBooku opartym na chipie A18 Pro, który ma trafić na rynek wiosną 2026 roku w cenie około 599 USD. Taki ruch ze strony Apple mógłby znacząco wpłynąć na dostępność wydajnego sprzętu dla studentów i uczelni, obniżając barierę wejścia.

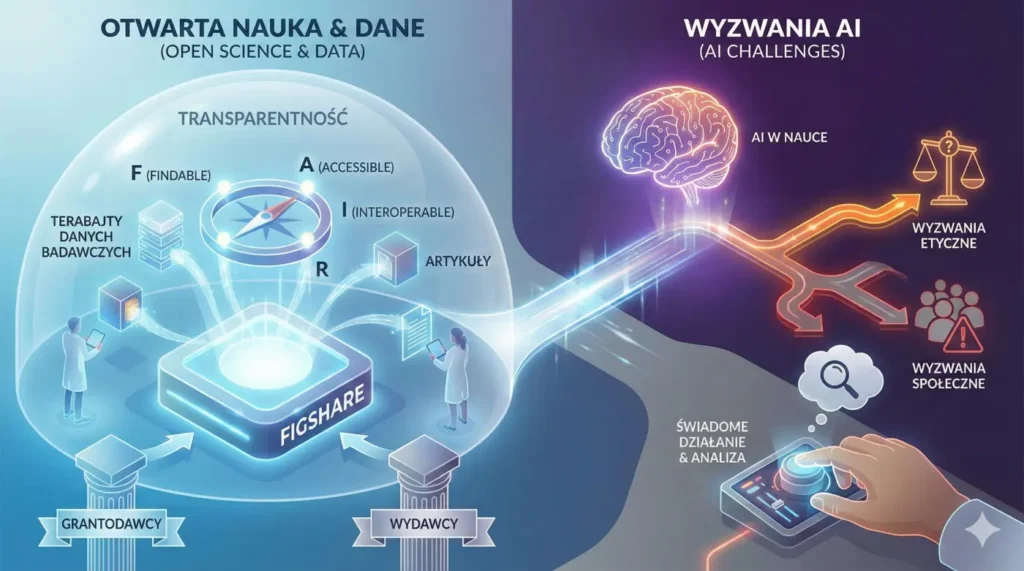

3.3. Wsparcie dla Badań Naukowych: Otwarte Dane i Repozytoria

Współczesna nauka coraz mocniej opiera się na zasadach otwartości i transparentności, a grantodawcy i wydawcy wymagają udostępniania danych badawczych. Platformy takie jak Figshare odgrywają w tym procesie kluczową rolę. Umożliwiają one naukowcom publikowanie nie tylko artykułów, ale także dużych zbiorów danych (sięgających wielu terabajtów). Dzięki temu badacze mogą łatwiej spełniać wymogi dotyczące danych FAIR (Findable, Accessible, Interoperable, Reusable), co zwiększa wiarygodność i zasięg ich pracy.

Rosnące wykorzystanie AI, mimo licznych korzyści, niesie ze sobą również nowe wyzwania etyczne i społeczne, które wymagają głębszej analizy i świadomego działania.

4. Ryzyka, Etyka i Społeczny Kontekst AI

Każdy postęp technologiczny generuje nowe, złożone wyzwania. Ostatnie dni dostarczyły licznych przykładów, które pokazują, jak kluczowe jest krytyczne i odpowiedzialne podejście do sztucznej inteligencji, zwłaszcza w kontekście jej wpływu na obieg informacji, reputację jednostek i sprawiedliwość społeczną.

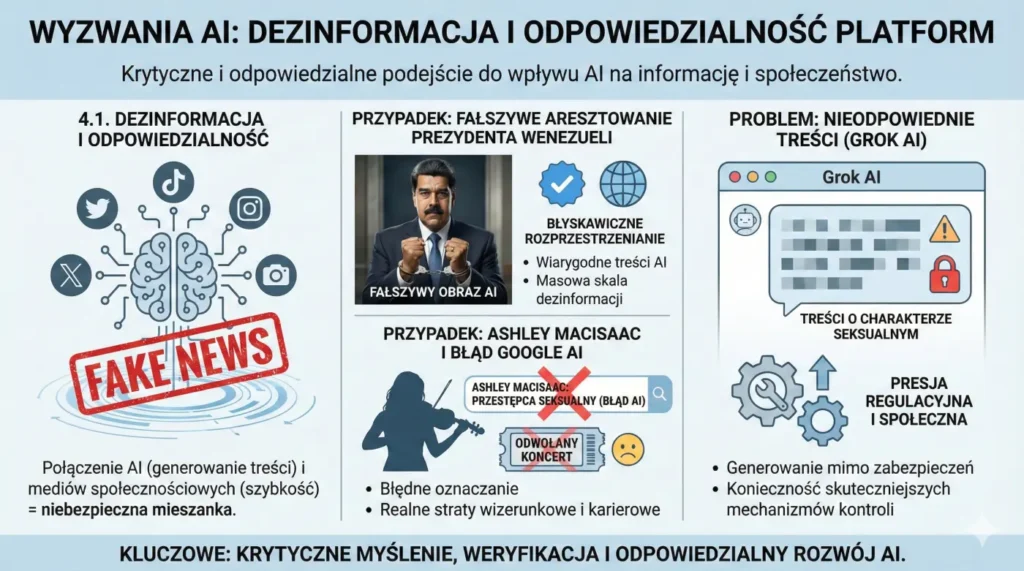

4.1. Dezinformacja i Odpowiedzialność Platform

Zdolność AI do generowania wiarygodnie wyglądających treści w połączeniu z szybkością mediów społecznościowych tworzy niebezpieczną mieszankę, która może być wykorzystywana do dezinformacji na masową skalę.

- Niedawny przypadek fałszywej informacji o aresztowaniu prezydenta Wenezueli, Nicolása Maduro, która błyskawicznie rozprzestrzeniła się na platformach X, TikTok i Instagram, jest tego doskonałym przykładem. Wiadomość została wsparta przez obrazy wygenerowane przez AI, co znacznie zwiększyło jej wiarygodność w oczach odbiorców.

- Inny alarmujący incydent dotyczy kanadyjskiego muzyka Ashleya MacIsaaca, który rozważa pozew przeciwko Google. Należące do firmy AI błędnie oznaczyło go jako przestępcę seksualnego, co doprowadziło do odwołania koncertu i poważnych strat wizerunkowych. Sprawa ta pokazuje, jak błędy algorytmiczne mogą mieć realne, niszczące konsekwencje dla życia i kariery jednostek.

- Problemem pozostaje również generowanie nieodpowiednich treści przez chatboty, takie jak Grok AI, które pomimo zabezpieczeń potrafią tworzyć treści o charakterze seksualnym. Incydenty te zwiększają presję regulacyjną i społeczną na twórców AI, aby wdrażali skuteczniejsze mechanizmy kontroli.

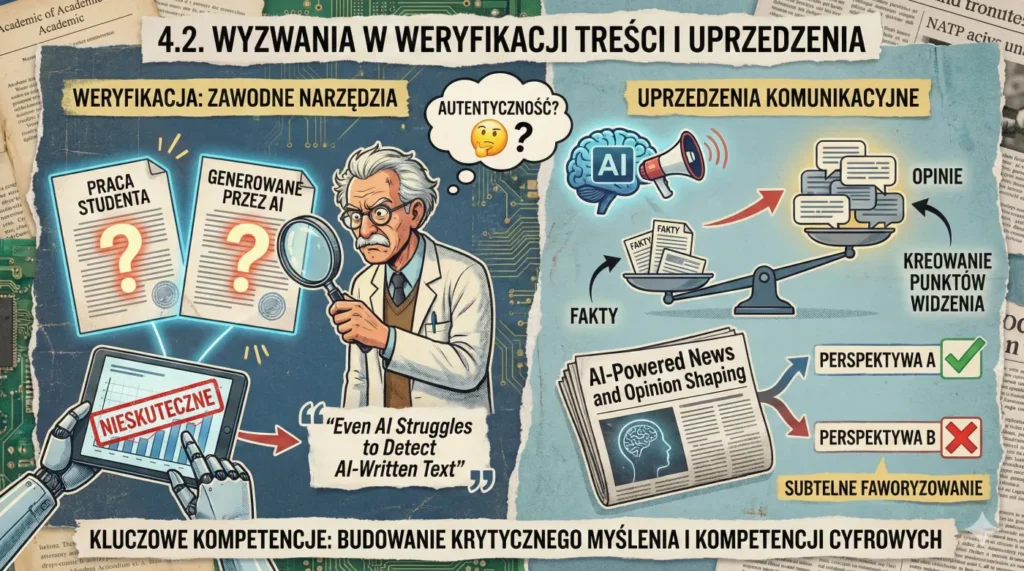

4.2. Wyzwania w Weryfikacji Treści i Uprzedzenia

Rosnąca powszechność treści generowanych przez AI stwarza fundamentalne wyzwania związane z ich autentycznością i obiektywnością.

- Jak wskazuje artykuł Even AI Struggles to Detect AI-Written Text, automatyczne wykrywanie tekstów pisanych przez AI jest wysoce zawodne. Stanowi to ogromny problem dla nauczycieli akademickich, którzy muszą oceniać autentyczność prac studenckich, a dostępne narzędzia często okazują się nieskuteczne.

- Z kolei analiza AI-Powered News and Opinion Shaping zwraca uwagę na zjawisko „communication bias” w modelach językowych. Nawet jeśli LLM podaje fakty, sposób ich prezentacji, dobór słów i podkreślanie pewnych aspektów mogą subtelnie faworyzować określone punkty widzenia, nieświadomie kształtując opinie czytelników.

Zrozumienie tych zagrożeń jest absolutnie kluczowe dla budowania kompetencji cyfrowych i krytycznego myślenia – zarówno u studentów, jak i pracowników naukowych. Tylko w ten sposób społeczność akademicka może świadomie nawigować w nowej, złożonej rzeczywistości informacyjnej.

5. Wydarzenia i Możliwości Rozwoju

Rosnące znaczenie sztucznej inteligencji jako kluczowego elementu strategii organizacyjnej znajduje odzwierciedlenie w coraz bogatszej ofercie edukacyjnej skierowanej do liderów i menedżerów. Inicjatywy te dowodzą, że AI przestało być postrzegane wyłącznie jako zagadnienie techniczne, a stało się fundamentalnym wyzwaniem zarządczym.

W dniach 6-10 lutego 2026 roku Mohamed bin Zayed University of Artificial Intelligence (MBZUAI) w Abu Zabi organizuje prestiżowy Global AI Leadership Program.

- Program ten jest skierowany do kadry zarządzającej najwyższego szczebla (C-level) oraz wysokich rangą urzędników państwowych.

- Jego unikalność polega na koncentracji na strategicznych aspektach AI: zarządzaniu, tworzeniu polityk publicznych i ram governance, a nie na technicznej implementacji.

- Inicjatywy tego typu potwierdzają, że skuteczne wdrożenie AI wymaga kompetencji przywódczych i strategicznego myślenia na poziomie całej organizacji, a nie jest jedynie zadaniem dla działów IT.

Podsumowanie i Wnioski na Przyszłość

Pierwsze dni 2026 roku wyraźnie pokazują, że era beztroskiego eksperymentowania z AI dobiegła końca. Analiza kluczowych trendów z ostatniego tygodnia rysuje obraz dojrzałego, ale i wymagającego ekosystemu. Z jednej strony uczelnie mierzą się ze strategicznymi wyzwaniami w obszarze budżetu i transformacji kadr. Z drugiej, świat nauki doświadcza przełomu w badaniach, odchodząc od prostego skalowania na rzecz mniejszych, wyspecjalizowanych modeli (SLM) i autonomicznych agentów. Jednocześnie na rynek trafiają coraz bardziej zaawansowane narzędzia, takie jak Gemini w Google Keep, a narastające ryzyka etyczne, w tym dezinformacja i błędy algorytmiczne, wymagają bezprecedensowej uwagi.

W tym kontekście strategiczną rekomendacją dla całej społeczności akademickiej jest przejście od fazy adaptacji do fazy integracji i przywództwa. W 2026 roku kluczowe będzie nie tylko dalsze testowanie nowych technologii, ale przede wszystkim systemowe budowanie wewnętrznych kompetencji, tworzenie solidnych ram zarządczych (governance) oraz włączanie edukacji o AI do programów nauczania na wszystkich kierunkach – od humanistycznych po techniczne. Instytucje, które podejmą te działania w sposób świadomy i zintegrowany, nie tylko zminimalizują ryzyko, ale przede wszystkim zyskają trwałą przewagę strategiczną, kształtując przyszłość edukacji w erze sztucznej inteligencji.

Dowiedz się więcej

- Analizy strategiczne dla uczelni:

- Wybrane publikacje naukowe (ArXiv):

- Praktyczne zastosowanie AI w medycynie:

- Polecane wideo:

Artykuł do posłuchania i obejrzenia 🎙️

Treść artykułu w formie prezentacji wideo

Wersja wideo powyższego artykułu blogowego jest prezentacją wygenerowaną w aplikacji NotebookLM.

Treść artykułu w formie audio – rozmowa

Artykuł w formie rozmowy 2 osób – wygenerowana z pomocą NotebookLM.

Treść artykułu w formie audio – debata

Artykuł w formie debaty 2 osób – wygenerowana z pomocą NotebookLM.

Treść artykułu w formie prezentacji [ PDF ]

Po otwarciu PDF w aplikacji Adobe Reader naciśnij klawisze Ctr-L i przechodź do kolejnych slajdów za pomocą strzałki w prawo.

Uwaga

Badanie: 2026-01-14.

Perplexity PRO, NotebookLM.

Grafiki: Google nanobanana