⚡ Szybki Przegląd tygodnia:

Trzeci tydzień marca 2026 roku przynosi fundamentalne przetasowania na rynku sztucznej inteligencji. Przechodzimy z fazy eksperymentalnych modeli generatywnych do pełnoprawnej Ery Agentowej. Google zaprezentowało innowacyjną technikę kompresji pamięci TurboQuant, która oszczędza zasoby i radykalnie przyspiesza działanie długoterminowej pamięci w modelach LLM. Z kolei DeepSeek zaskakuje świat naukowy wydajnością systemów open-source opartych na grupowym optymalizowaniu polityki (GRPO). Oznacza to, że zaawansowane systemy sztucznej inteligencji stają się coraz tańsze we wdrożeniu i potrafią autonomicznie zarządzać całymi procesami badawczymi i analitycznymi. Dla społeczności akademickiej i studentów Uniwersytetu Ekonomicznego w Krakowie (UEK) jest to jasny sygnał, że kompetencje rynkowe przesuwają się od prostej obsługi czatbotów do zarządzania wieloagentowymi architekturami i nadzorowania w pełni automatycznych cyklów pracy.

Z perspektywy administracyjno-uczelnianej ogromne znaczenie nabiera europejska inicjatywa AI4Gov Accelerate. Projekt ten, rozwijany przy udziale czołowych uniwersytetów (m.in. w Krems), ma na celu przygotowanie administracji publicznej do wydajnego i bezpiecznego wykorzystania sztucznej inteligencji w oparciu o unijny AI Act. Uczelnie stają przed wyzwaniem nie tylko wdrażania rozwiązań AI w swoich procesach dydaktycznych i operacyjnych (ucząc się od liderów skandynawskich), ale również tworzenia piaskownic cyfrowych (sandboxes) do testowania bezpiecznych aplikacji w sferze publicznej. Dla administracji UEK to wyraźny katalizator do przyspieszenia transformacji cyfrowej, podczas gdy kierunki zarządzania publicznego zyskują zupełnie nowy, kluczowy obszar badawczy na styku technologii i prawa.

Na arenie biznesowej widzimy, że unijne rozporządzenie AI Act zaczyna realnie kształtować rynek pracy i globalne strategie największych korporacji. Anthropic, ze swoim modelem Claude (zwłaszcza seria 4 i 4.5), zaczął wyprzedzać OpenAI w segmencie rozwiązań dla przedsiębiorstw zdominowanych przez wymogi bezpieczeństwa i przewidywalności (compliance). Wzrost zapotrzebowania na specjalistów takich jak AI Compliance Officers czy AI Risk Analysts kreuje niezwykłe możliwości dla absolwentów wydziałów ekonomii, zarządzania i prawa UEK. Biznes musi teraz równoważyć agresywną innowację z twardymi regulacjami, a koszty zgodności tworzą nowe nisze doradcze i audytowe, stając się jednym z najbardziej dochodowych sektorów usług prawno-biznesowych w tej dekadzie.

🎙️ Posłuchaj lub Obejrzyj

Zachęcamy do zapoznania się z naszymi materiałami przygotowanymi na bazie tego wydania newslettera. Dowiedz się więcej, słuchając dyskusji ekspertów lub oglądając nasz cotygodniowy podocast:

– Audio Overview

– Video Overview

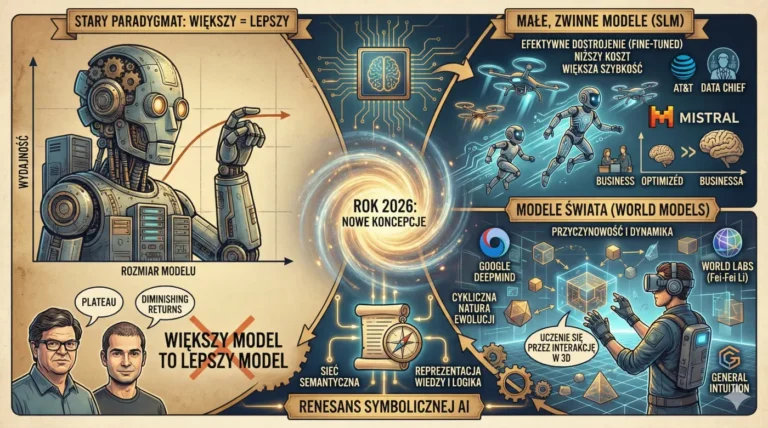

🚀 1. Radar Technologiczny

Krajobraz wielkich modeli językowych (Large Language Models) w połowie marca 2026 roku wyraźnie ewoluuje z fascynacji samą wielkością rozwiązań ku optymalizacji operacyjnej i zaawansowanemu wnioskowaniu. Według najnowszych raportów, nie obserwujemy już zaledwie wyścigu na liczbę parametrów, ale raczej bezwzględną batalię o rozwój systemów „agentowych” zdolnych do wieloetapowego planowania bez interwencji człowieka. Na czoło wysuwają się tu trzy potężne podmioty: OpenAI z serią o1 i kolejnymi iteracjami z rodziny GPT, Google DeepMind ze swoimi modelami Gemini 3 oraz Anthropic ze swoim silnie zorientowanym na bezpieczeństwo korporacyjne modelem Claude 4.5 Sonnet. W połowie marca kluczowym wydarzeniem było doprezentowanie innowacyjnych metod kompresji – w tym rozwiązania TurboQuant od Google, które zmniejsza zużycie pamięci podręcznej typu key-value o sześć razy, czyniąc modele znacznie wydajniejszymi do utrzymywania ogromnych strumieni kontekstu.

Co te techniczne przełomy oznaczają w praktyce dla środowiska naukowego oraz biznesu? Przede wszystkim modele agentowe, wyposażone w tzw. „chain-of-thought”, przestają być tylko inteligentnymi wyszukiwarkami. Stają się swego rodzaju aktywnymi asystentami zespołów: potrafią samodzielnie gromadzić dane, pisać skrypty, debugować kod, a wręcz organizować pracę projektową. Analitycy wielokrotnie podkreślają fenomen modelu Claude Sonnet, który zaskarbił sobie uznanie programistów i podmiotów korporacyjnych dzięki natywnym powiązaniom ze środowiskami deweloperskimi i rozbudowanym mechanizmom weryfikacji rezultatów (Reinforcement Learning with Verifiers). To ogromna zmiana paradygmatu, ponieważ AI staje się bezpośrednim członkiem zespołów programistycznych i badawczych. Do tego dołącza sektor open-source, prowadzony przez francuskiego giganta Mistral oraz wywodzący się z Azji DeepSeek, którego nowatorskie metody adaptacji GRPO do małych modeli umożliwiają osiąganie wybitnych rezultatów w logice i matematyce przy nieporównywalnie niższych kosztach treningu.

Dla studentów kierunków informatycznych, analitycznych i biznesowych na Uniwersytecie Ekonomicznym w Krakowie (UEK) ewolucja ta wymusza radykalną zmianę w filozofii budowania projektów zaliczeniowych, a w przyszłości – w sposobie wykonywania pracy. Tradycyjne programowanie staje się powoli umiejętnością nadzorowania kodujących agentów AI. Studenci Informatyki Stosowanej z jednej strony zyskują niesamowite narzędzia wspierające budowę prototypów w kilka godzin, z drugiej zaś – wyzwanie polega dziś na umiejętnym konstruowaniu ram weryfikacyjnych (testów) dla wyników sztucznej inteligencji. W obszarze zarządzania danymi i uczenia maszynowego (Machine Learning), główny ciężar kompetencyjny na uczelniach przeniesie się w kierunku strojenia wydajnościowego („fine-tuning”, optymalizacja „Small Language Models”), integracji systemów wieloagentowych w środowiskach biznesowych oraz zarządzania bezpieczeństwem lokalnie przetwarzanych danych. Obserwacja trendów pokazuje wyraźnie: przyszli absolwenci UEK, od zarządców projektów cyfrowych po audytorów, nie będą pracować z samym kodem, ale będą korygować procesy inferencyjne algorytmów. Programy kształcenia muszą błyskawicznie adaptować strategie, w których studenci będą poddawani scenariuszom, gdzie systemy agentowe już działają, a zadaniem człowieka jest audyt logiczny i wytyczanie strategicznych ram ich pracy. Zrozumienie takich modeli jak systemy agentów, RAG z rozszerzonym kontekstem czy open-source staną się cenniejsze niż same fundamenty programowania deklaratywnego.

🎓 2. Akademia i Administracja w Praktyce

Transformacja sektora edukacji wyższej w Europie nabrała bezprecedensowego tempa w wyniku presji technologiczno-prawnej. Marzec 2026 r. to czas dyskusji na temat praktycznego zaadaptowania generatywnego AI do trzonu działalności uniwersyteckiej, co wyraźnie pokazała dyskusja ekspercka i konferencja środowiskowa organizowana przez innowatorów z europejskich ministerstw i czołowych uczelni. Doświadczenia liderów, w tym silny strumień doświadczeń ze Skandynawii, wskazują jednoznacznie, że do płynnego i bezpiecznego wdrożenia sztucznej inteligencji potrzebne są zintegrowane środowiska cyfrowe – „cyfrowy kręgosłup” – uczelni. Rozwój kompetencji staje się sprawą centralną. Inicjatywy takie jak AI4Gov Accelerate (z udziałem m.in. austriackiego University for Continuing Education Krems) tworzą ogólnoeuropejskie, scentralizowane modele szkoleniowe, dążąc do wykształcenia kadr władających administracją wspieraną przez sztuczną inteligencję w sposób zgodny z wymogami prawnymi i etycznymi.

Zarządzanie publiczne uczelnią to w dużej mierze zarządzanie nieprzebranymi zbiorami danych i złożonymi procesami administracyjnymi, ocenianiem kompetencji i sprowadzaniem finansowania. Systemy AI powoli przenikają do tych sfer. Ewaluacja projektów naukowych, optymalizowanie planów zajęć, automatyczne procedowanie formalności związanych w tokiem studiów to obszary, gdzie korzyści operacyjne mogą sięgać milionów zaoszczędzonych godzin. Z drugiej jednak strony – na administrację narzucane są obowiązki unijne, m.in. wymagania stawiane przez EU AI Act, które dla tzw. podmiotów dostarczających kluczową edukację (kategoria rozwiązań wysokiego ryzyka), oznacza bezwzględny nakaz utrzymywania transparentności i pełnego „human oversight” (nadzoru ludzkiego). Nie można pozwolić na zjawisko wykluczenia (np. dyskryminacji w procesach akceptacji podań) w algorytmach optymalizujących. Stąd rewolucja w obszarze „sandboxing” – środowisk akademickich odciętych od sieci testowych, pozwalających na eksperymentowanie na natywnych danych uczelnianych i testach algorytmów predykcyjnych w tzw. piaskownicach innowacyjnych.

Dla administracji UEK wyciągnięcie wniosków z bieżącego tygodnia to niepowtarzalna szansa na przejęcie roli polskiego pioniera innowacji w sektorze publicznym. Otwiera się przestrzeń na budowę własnych, dostosowanych baz RAG (Retrieval-Augmented Generation) opartych o wewnętrzne systemy zarzadzania wiedzą, prawo oświatowe i wytyczne uniwersyteckie. Należy rozważyć organizację eksperckich sztabów ds. Data Governance i powołanie uczelnianej komórki ds. nadzoru AI (AI Governance Board). To ogromna szansa na zaangażowanie kadr dydaktycznych, kół naukowych oraz ekspertów uniwersyteckich – absolwenci polityki publicznej, socjologii i e-administracji posiadają unikatowe predyspozycje, aby takie procesy wdrażać. Stworzenie u na uniwersytecie „AI-ready” infrastruktury i cykliczne organizowanie warsztatów dla Dziekanatów, Biur Karier i Zarządu zmniejszy obciążenie biurokratyczne. W ten sposób kadra UEK będzie mogła skupić się na innowacjach, budowaniu relacji i indywidualnej pracy rozwojowej ze studentem – czymś, czego sztuczna inteligencja na obecnym etapie zreplikować nadal nie potrafi i szybko nie zdoła. Ukończenie systemowych rozwiązań wzmacniających „AI Literacy” pośród biurokracji uczelnianej powinno stanowić najwyższy priorytet na drugą połowę dekady.

💰 3. Biznes, Ekonomia, Etyka i Prawo

Regulacje prawne uderzający w rynek zderzyły się z cyfrową rzeczywistością przedsiębiorstw niczym rozpędzony pociąg. Po uchwaleniu przez Unię Europejską AI Act i pierwszych skutecznych etapach egzekwowania prawa (słynne terminy zakazu na systemy „nieakceptowalnego ryzyka”), krajobraz gospodarczy 2026 roku ulega transformacji pod dyktando polityki zgodności („compliance”). Rynek LLM dla wielkich korporacji stał się przestrzenią, w której nie liczy się wyłącznie moc obliczeniowa. Wyraźny dowód stanowi opublikowany w połowie marca raport badawczy, z którego wynika, że amerykański startup Anthropic po raz pierwszy w udziale w portfelach potężnych korporacji pokonał giganta OpenAI. Przyczyną tej przesiadki nie jest różnica w mocy samych modeli, lecz obsesyjne zaangażowanie twórców Claude’a w kwestie kontroli, weryfikacji i bezpieczeństwa etycznego, które okazały się o wiele ważniejsze dla europejskich działów finansowych i prawnych niż same techniczne „fajerwerki”.

Kwestie zgodności i etyki rodzą zupełnie nowe wyzwania makroekonomiczne. Koszt wdrożenia rozwiązań zgodnie z systemami zarządzania ryzykiem narzuconymi przez regulacje europejskie oscyluje, według różnych eksperckich wyliczeń, wokół średniej rzędu 300 000 euro dla przedsiębiorstw operujących modelami wysokiego ryzyka (np. ocena zdolności kredytowej czy procesy biometryczne). Koszt ten jest pomijalny dla globalnych graczy, ale staje się gigantyczną barierą wejścia (barrier of entry) dla nowoczesnych technologicznie firm sektora MŚP i innowacyjnych startupów z terenów Małopolski, poszukujących szybkiego awansu na globalnym rynku. Uwidacznia to niepokojący trend na gruncie ekonomicznym: z perspektywy teorii rynku powracamy w stronę oligopolizacji zasobów opartej nie tylko o uwarunkowania technologiczne i olbrzymie koszty prądu lub procesorów GPU, ale także koszty administracyjne, sprzyjające konsolidacji kapitału na kontynencie. Systemy wysokiego ryzyka, np. z zakresu bankowości i HR, padają ofiarą drastycznych audytów danych, a każda decyzja rekrutacyjna oparta na AI musi posiadać natywną wyjaśnialność i brak inklinacji (biasu).

Odpowiedź wydziałów ekonomicznych, finansowych i prawniczych UEK musi być jednoznaczna: właśnie rodzi się przed nami najbardziej chłonny i lukratywny rynek usług profesjonalnych najbliższej dekady. „AI Governance”, zarządzanie ryzykiem modelowania algorytmicznego, wytyczanie ścieżek „audytu etycznego” innowacji. Dzisiejsi inwestorzy ryzykowni i dyrektorzy finansowi nie decydują o produkcie bez pełnego raportu Compliance. Studenci przygotowywani u nas do wejścia w rynek finansowy bądź rekrutacyjny (HR) powinni na pamięć znać postanowienia AI Act, a przyszli prawnicy ekonomiczni – umieć szacować skutki „dyskryminacji w procesach algorytmicznego modelowania”. Nowopowstające role na rynku, takie jak AI Compliance Officer czy AI Ethics Consultant, charakteryzują się potężnymi zarobkami i gigantycznym zapotrzebowaniem. Wykorzystując rynkowe zapotrzebowanie, UEK powinen rozwijać międzykierunkowe, zintegrowane formy edukacyjne – na styku techniki, ekonomii i prawa – by uwalniać na rynek specjalistów nieustępliwych względem ochrony danych, potrafiących wydać wiążące i kompetentne decyzje o tym, czy dany bank w Europie bezpiecznie obroni nowo wytrenowany model językowy przed organem regulacyjnym karzącym na kwoty sięgające do 7% rocznych, światowych obrotów instytucji.

📚 4. Przegląd Naukowy i Wydarzenia

Początek roku badawczego i zbliżające się wiosenne konferencje stanowią kluczowy pulsacyjny punkt światowego rozwoju nauk maszynowych. Obserwujemy znaczny wysyp pre-printów oraz agregowanych repozytoriów „AI for Science”, które dokumentują i mapują zastosowania sztucznej inteligencji bezpośrednio do rozwijania tzw. trudnych nauk (biologia organiczna, materiałoznawstwo). Potężnym czynnikiem demokratyzującym badania jest gwałtowny marsz ruchu „Open Science”, którego wizytówką stało się zbiorcze repozytorium „The Stack”. Agreguje o ponad 6 terabajtów swobodnie licencjonowanych plików kodu źródłowego. Dzięki nim możliwe staje się swobodne prowadzenie badań nad algorytmami generacji sztucznych języków programowania, co wcześniej zarezerwowane było wyłącznie pod wewnętrzne rygory gigantów platformowych w sposób niezwykle ściśle strzeżony. Dostępność zbiorów treningowych – darmowych, udokumentowanych i przemyślanych metadanych typu format Croissant, proponowany m.in. na otwartych blogosferach – tworzy nowe szanse dla każdego zaangażowanego badacza naukowego, obojętnie z jakiego zakątka Europy operuje.

Ogromnym problemem poruszanym masowo na forach publikacji (w tym przez repozytoria i organizacje ML-eval) jest zjawisko niekompletności metryk podających osiągi rynkowe modeli (tzw. „leaderboards”). Publikacje naukowe uderzają w problematykę „zjawiska optymalizacji prostej oceny” w uczeniu głębokim. Dowiodły one ewidentnie, że bardzo wiele korporacyjnych modeli testowanych jest pod z góry znane im benchmarki, ulegając przeuczeniu na wynik oceny (tzw. data contamination w zestawach ewaluacyjnych). Prowadzi to do postulatów ujednolicania standardów oceny, otwierając przed badaczami możliwości zaproponowania w pełni niezależnych, recenzowanych naukowo metodologii walidacyjnych. Społeczności pracują także nad organizacją potężnych wyzwań jak ICLR rozstrzygany w nadchodzących miesiącach w rejonie Azji (Singapur), czy chociażby mniejszych, pragmatycznych konkursów europejskich (np. SimpleText CLEF, automatyczna klasyfikacja nowatorskich osiągnięć AI z treści publikacji). Trzon debaty w dziedzinie sztucznej inteligencji przesuwa się obiektywnie od samych algorytmów predykcyjnych do naukometrii i filozofii analitycznej opartej na weryfikacji danych bazowych. To „nauka o nauce z algorytmami”.

Wyłania się tutaj wyraźna rekomendacja i wezwanie do działania dla środowiska krakowskich badaczy współpracujących wokół Uniwersytetu Ekonomicznego. Konferencje oparte na metodologiach ilościowych silnie poszukują eksperckiej wiedzy w zakresie ujednoliconych metryk testowych i walidacji obiektywnej modeli biznesowych w badaniach ekonomicznych. Naukowcy UEK w dziedzinie statystyki, ekonometrii czy finansów mogą stać się „trzecią połówką jabłka” – grupą wprowadzającą solidne modele weryfikacji efektywności tych modeli tam, gdzie zespoły inżynieryjne zawodzą skupiając się tylko na skalowalności i bezwzględnej prędkości wnioskowania. Czerpiąc z baz otwartych (The Stack lub Hugging Face), środowisko naukowe uczelni ma niebywałą okazję publikować analizy wykorzystania systemów lokalnych np. do prognozowania cen i wykrywania kryzysów ubezpieczeniowych, publikując wyniki nie tylko lokalnie, a w periodykach o statusie Q1, walcząc na otwartym ringu obok największych instytutów na świecie. Przyszłością ewaluacji jest nie to JAK model napisze wiersz, ale to jak poprawnie wywnioskuje logikę zależności rynkowej – a do testowania tych logik nikt nie jest przygotowany lepiej niż zaawansowani ekonomiści uczelni takich jak Uniwersytet Ekonomiczny.

🎯 5. Podsumowanie Tygodnia

Trzeci tydzień marca 2026 roku nie pozostawia złudzeń w kwestii przyszłości: era fascynacji „generatywnymi” odpowiedziami LLM bezpowrotnie przemija stając się towarem powszechnego użycia (commodity), a władzę obejmują zautomatyzowane sieci agentowe oraz reżimy kontrolne na styku prawa (AI Act) i techniki weryfikacyjnej. Potwierdzają to z jednej strony wielkie postępy w infrastrukturze pamięci dla systemów AI (TurboQuant w Google, nowatorskie silniki DeepSeek w obszarze open-source), z drugiej natomiast przerażająco realne koszty i sankcje narzucone przez Unię Europejską stawiające nowe wyzwania etyczne, prawne i rekrutacyjne przed organizacjami. W obszarze instytucji publicznych i wyższych uczelni wywołuje to niezwykłą dynamikę: wdrażanie „bezpiecznego” środowiska (sandboxing, wirtualne warsztaty na serwerach) wyrasta przed nami jako nieodzowny kierunek ewolucji oświaty.

Dla całej zbiorowości studencko-pracowniczej na UEK oznacza to, że umiejętności technologiczne nie stoją już oddzielnie od dziedzin zarządzania czy prawa korporacyjnego. Zbiegają się one w jednej postaci tzw. AI Governance – zarządzania poprawnością, bezpieczeństwem i skuteczną integracją ekosystemów wspomagających. Bierność dla naszej administracji oznacza utknięcie w nienowoczesnych rozwiązaniach z wysokim ryzykiem niepowodzenia i sprowadzenia błędów z tytułu zaniechania, podczas gdy agresywne, systemowe wdrażanie kompetencji budowlanych wokół AI obdarzy każdego absolwenta, doktoranta, pracownika naukowego narzędziem do tworzenia rzeczy innowacyjnych i kreujących nadwartość intelektualną w regionie. Konkluzja tygodnia? Sztuczna inteligencja zyskała sprawczość; czas odzyskać i zaostrzyć sprawczość ludzką w jej metodycznym projektowaniu, ewaluowaniu i kontrolowaniu.

🔗 6. Skarbnica Wiedzy

- KPMG – Decoding the EU AI Act – Doskonała, komplementarna analiza wdrożenia unijnego AI Act oraz identyfikacja stref ryzyka korporacyjnego przez jednego z „Wielkiej Czwórki” graczy finansowych. Lektura obowiązkowa dla badaczy ryzyka finansowego.

- Anthropic: Claude Enterprise Era – Dogłębny raport rynkowy VC Menlo pokazujący przewrotną trajektorię preferencji korporacji. Wyjaśnia on dlaczego modele typu Claude (Anthropic) zaczęły dominować nad OpenAI dzięki podejściu skoncentrowanym na zaufaniu („Trust and Complience”).

- The AI Avalanche: Agentic Breakthroughs – Wnikliwe ujęcie nowatorskich przełomów architektonicznych z zeszłego tygodnia (m.in. model TurboQuant), zwiastujące gigantyczne obniżki w kosztach wejścia dla inżynierów operujących na środowiskach wieloagentowych (Agentic Era).

- AI4Gov Accelerate Project – Dokumentacja dotycząca rozwoju i pionierskiego wdrażania bezpiecznych piaskownic, tzw. AI „sandboxing”, opracowanego przez wiodące europejskie uniwersytety w relacji kształcenia kadr dla e-Administracji publicznej.

- Papers – ML Evaluation Standards & Guidelines – Repozytorium GitHub poświęcone nowym rygorystycznym kryteriom i metodologiom ewaluacyjnym, stawiające pytania o transparentność oceniania wyników potężnych modeli wielomodalnych AI – kluczowe dla analityków Big Data.

📖 7. Bibliografia

- European Parliament. (2024). Artificial Intelligence Act: EU legislation on AI. Pobrane z: https://www.europarl.europa.eu/

- Menlo Ventures. (2025). Mid-Year LLM Market Update: Enterprise AI Trends. Pobrane z: https://menlovc.com/

- KPMG International. (2024). Decoding the EU Artificial Intelligence Act: Impact and Scope.

- Anthropic. (2026). Claude 4.5 Sonnet: Enterprise Capabilities and Safety Verification.

- University for Continuing Education Krems. (2026). Efficient administration through AI: AI4Gov Accelerate. Pobrane z: https://www.donau-uni.ac.at/

- DeepSeek. (2026). 7B Open Source MoE: From Pretraining to GRPO. arXiv.

- Google DeepMind. (2026). TurboQuant: Compression and Memory Management in Next-Gen LLMs. Google Open Source Blog.

- Digital Education Council. (2026). EU AI Act: What it means for universities. Pobrane z: https://www.digitaleducationcouncil.com/