AI News dla UEK Tydzień#16 (11-17 kwietnia 2026): Przełomy w medycynie i cyberbezpieczeństwie

Artykuł w formie audio – rozmowa 2 osób – treść wygenerowana z pomocą NotebookLM.

Czas trwania: 25 min 32 sek.

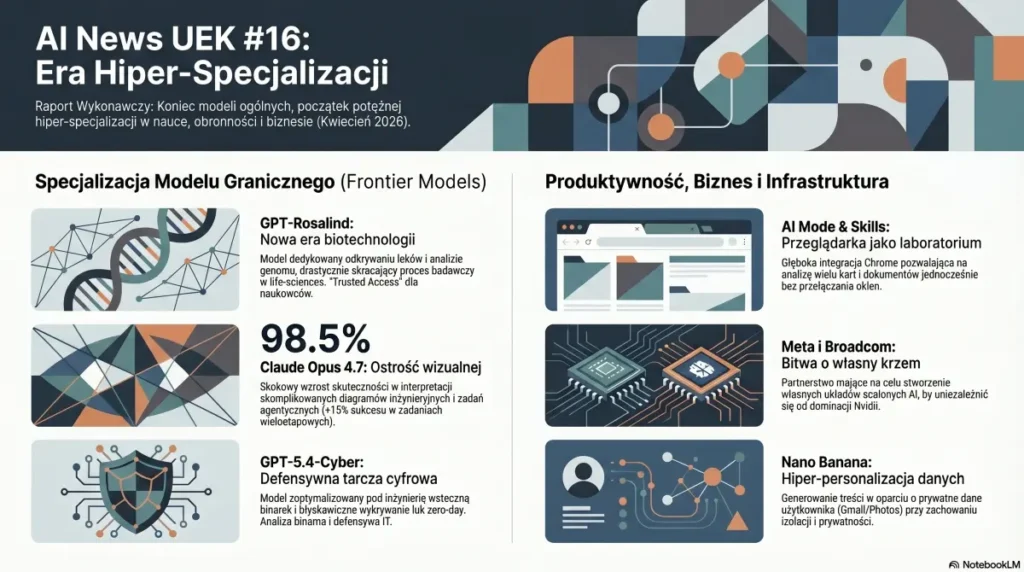

⚡ Szybki Przegląd tygodnia:

Rosalind i nowa era biotechnologii

W tym tygodniu OpenAI zrzuciło prawdziwą bombę na rynek life-sciences, prezentując model GPT-Rosalind. Nie jest to kolejny chatbot do pisania wypracowań, lecz potężne narzędzie dedykowane odkrywaniu leków, analizie genomu i modelowaniu białek. Nazwany na cześć Rosalind Franklin, model ten ma szansę zrewolucjonizować sposób, w jaki naukowcy (również ci z naszej uczelni współpracujący z sektorem medycznym) podchodzą do najbardziej skomplikowanych zagadnień biochemicznych. OpenAI zdecydowało się na model „Trusted Access”, co oznacza, że dostęp do najpotężniejszych funkcji Rosalind będzie ściśle kontrolowany, aby zapobiec potencjalnym nadużyciom w tworzeniu substancji niebezpiecznych. To sygnał, że giganci AI zaczynają traktować bezpieczeństwo biologiczne z najwyższą powagą.

Wojna obronna w wersji Cyber

Zaledwie dzień przed Rosalind, OpenAI zaprezentowało inny wyspecjalizowany wariant: GPT-5.4-Cyber. Jest to model stworzony wyłącznie do celów defensywnego cyberbezpieczeństwa. W przeciwieństwie do standardowego modelu GPT-5.4, wersja Cyber ma obniżone bariery odmowy w przypadku zapytań o luki w kodzie, ale tylko jeśli użytkownik jest zweryfikowanym „obrońcą”. Pozwala to na błyskawiczne reverse-engineering binarek i wykrywanie zero-dayów w infrastrukturze krytycznej. Dla administracji UEK i naszych specjalistów od bezpieczeństwa IT to jasny sygnał: AI staje się fundamentem nowoczesnej tarczy cyfrowej, a umiejętność współpracy z takimi modelami będzie kluczową kompetencją przyszłości.

Google zmienia przeglądarkę w laboratorium

Google nie pozostało dłużne, wprowadzając AI Mode oraz Skills w przeglądarce Chrome. To nie są już tylko widżety, ale głęboka integracja, która pozwala na analizę otwartych kart, dokumentów i obrazów w czasie rzeczywistym. Studenci UEK mogą teraz jednym kliknięciem wyciągnąć kluczowe trendy z dziesięciu otwartych raportów finansowych jednocześnie. Dodatkowo, model Nano Banana wszedł w fazę „personalnej inteligencji”, co pozwala na generowanie grafik i analiz w oparciu o prywatne dane użytkownika (np. zdjęcia z Google Photos) przy zachowaniu najwyższych standardów prywatności. To totalna zmiana paradygmatu – AI przestaje być obcym narzędziem na zewnętrznej stronie, a staje się integralną częścią naszego systemu operacyjnego i przeglądarki.

🚀 1. Radar Technologiczny

GPT-Rosalind: Granica między AI a Bioinformatyką

Najważniejszym wydarzeniem tygodnia jest bez wątpienia premiera GPT-Rosalind. Model ten jest określany jako „frontier reasoning model” i został wytrenowany na gigantycznych zbiorach danych z zakresu biologii molekularnej, chemii organicznej i farmakologii. OpenAI nie podało co prawda dokładnej liczby parametrów, ale z pierwszych raportów wynika, że Rosalind radzi sobie z przewidywaniem interakcji białkowych z precyzją, która wprawia w osłupienie ekspertów. Co to oznacza dla nas? Przede wszystkim to dowód na to, że era uniwersalnych modeli powoli ustępuje miejsca erze specjalizacji. Modele, które „wiedzą wszystko po trochu”, zostaną zastąpione przez specjalistów, którzy potrafią rozwiązywać problemy godne Nagrody Nobla.

Warto zwrócić uwagę na mechanizm Trusted Access. OpenAI wprowadza rygorystyczną weryfikację użytkowników. Aby uzyskać dostęp do pełnych możliwości Rosalind, naukowiec lub instytucja muszą przejść proces certyfikacji. Ma to zapobiec sytuacji, w której AI mogłoby zostać wykorzystane do projektowania szkodliwych patogenów. To fascynujący przykład tego, jak zarządzanie ryzykiem w AI staje się równie ważne co sama moc obliczeniowa. Z perspektywy UEK, badania nad ekonomicznym aspektem wprowadzania takich rozwiązań na rynek farmaceutyczny mogą stać się niezwykle chodliwym tematem prac dyplomowych i badawczych. Jak wycenić dostęp do modelu, który skraca proces odkrywania leku z 10 lat do kilku miesięcy? To pytania, na które nasi ekonomiści będą musieli wkrótce odpowiedzieć.

GPT-5.4-Cyber: AI jako analityk operacyjny

Kolejnym potężnym narzędziem jest GPT-5.4-Cyber. To wariant modelu GPT-5.4, który został „dostrojony” do potrzeb cyber-defensywy. Najciekawszym aspektem tego modelu jest jego zdolność do analizy binarnej. Potrafi on wziąć skompilowany, niezrozumiały dla człowieka kod maszynowy i przedstawić go w formie czytelnych diagramów i wyjaśnień w języku naturalnym. To narzędzie, które może skrócić czas reakcji na incydent z godzin do sekund. W kontekście bezpieczeństwa finansowego i danych osobowych na uczelni, wdrożenie asystentów Cyber-AI wydaje się być tylko kwestią czasu.

Wprowadzenie GPT-5.4-Cyber to także ważny krok w debacie o etyce AI. Czy udostępnienie modelu, który potrafi tak świetnie analizować luki, nie ułatwi pracy hakerom? OpenAI twierdzi, że nie, ponieważ model jest monitorowany i dostępny tylko dla zaufanych podmiotów. Jednakże historia pokazuje, że „zamknięte” modele często wyciekają lub są replikowane przez otwarte społeczności. To otwiera pole do dyskusji o odpowiedzialności producentów AI. Czy w przyszłości każda firma (również taka z Krakowa czy Małopolski) będzie potrzebowała „licencji na AI”, aby korzystać z najbardziej zaawansowanych narzędzi obronnych?

Ewolucja Codex i programowanie wspomagane

OpenAI odświeżyło również Codex, wprowadzając model płatności „pay-as-you-go” dla zespołów deweloperskich. Codex jest teraz używany przez miliony programistów tygodniowo, a nowa aktualizacja skupia się na skalowalności i współpracy. Nowy interfejs pozwala na współdzielenie kontekstu projektu między wieloma użytkownikami, co oznacza, że AI rozumie nie tylko jedną funkcję, ale architekturę całego systemu, nad którym pracuje zespół. Dla naszych studentów informatyki stosownej i ekonomicznej to ważna informacja: umiejętność korzystania z asystentów kodowania staje się standardem, a nie dodatkiem.

Najnowszy Codex wykazuje również znacznie lepsze wyniki w testach SWE-Bench, osiągając skuteczność na poziomie 80.8% w samodzielnym rozwiązywaniu błędów w projektach typu open-source. To ogromny skok w porównaniu do wersji sprzed roku. Czy to oznacza koniec pracy dla programistów? Absolutnie nie. To oznacza, że programista staje się ** architektem i weryfikatorem**, a nie „klepaczem kodu”. Na UEK powinniśmy kłaść coraz większy nacisk na naukę projektowania systemów i logiki biznesowej, bo to są obszary, w których człowiek (wspierany przez asystenta) wciąż pozostaje niezastąpiony.

🎓 2. Akademia i Administracja w Praktyce

AI Mode w Chrome: Cyfrowy asystent badań

Google wprowadziło funkcję AI Mode do przeglądarki Chrome, co ma bezpośredni wpływ na to, jak uczymy się i pracujemy na uczelni. Wyobraźmy sobie, że podczas pisania artykułu naukowego lub przygotowywania prezentacji na seminarium, możemy otworzyć boczny panel, który ma dostęp do treści wszystkich naszych otwartych kart. Możemy zapytać: „Znajdź sprzeczności między tymi trzema raportami dotyczącymi inflacji” albo „Zasugeruj bibliografię na podstawie tego wątku”. To rozwiązanie eliminuje konieczność ciągłego kopiowania i wklejania treści do zewnętrznych chatbotów.

Dla administracji UEK integracja ta stwarza niesamowite możliwości w zakresie zarządzania wiedzą. Urzędnik przygotowujący sprawozdanie może w ułamku sekundy porównać aktualne rozporządzenia z wewnętrznymi regulaminami uczelni. Co więcej, funkcja Skills w Chrome pozwala na tworzenie własnych, mikrowydajnych workflowów – np. automatyczne formatowanie cytowań według standardu APA 7 czy błyskawiczne tłumaczenie skomplikowanych tekstów prawniczych z zachowaniem kontekstu akademickiego. To koniec ery „ręcznego przekładania papierów” w cyfrowej formie.

Nano Banana i personalizacja danych studenta

Model Nano Banana, który napędza teraz personalną inteligencję w aplikacji Gemini, to prawdziwy przełom w podejściu do danych. Pozwala on na generowanie unikalnych treści (tekstowych i graficznych) w oparciu o nasze własne archiwum w Gmailu czy Google Photos, ale bez wysyłania tych danych do „ogólnego mózgu” AI. Google zapewnia, że proces ten odbywa się w bezpiecznej, izolowanej przestrzeni. Studenci UEK mogą wykorzystać to do tworzenia spersonalizowanych notatek, wizualizacji projektów czy nawet planowania grafiku zajęć na podstawie maili od wykładowców.

Warto jednak wspomnieć o ograniczeniach regionalnych – ze względu na regulacje europejskie, niektóre funkcje personalizacji nie są jeszcze dostępne w EOG/Szwajcarii. To doskonały punkt wyjścia do dyskusji na zajęciach z prawa cyfrowego: jak pogodzić potęgę hiper-personalizacji AI z restrykcyjną ochroną prywatności? Czy krakowski student powinien mieć gorsze narzędzia niż jego kolega ze Stanfordu tylko dlatego, że chroni go RODO? To dylematy, które będziemy musieli rozstrzygnąć na poziomie politycznym i etycznym.

Gemini 3.1 Flash TTS: Głos nauki

Kolejną nowością od Google jest model Gemini 3.1 Flash TTS. Jest to zaawansowany system generowania mowy, który obsługuje ponad 70 języków (w tym polski!) i oferuje ponad 200 punktów kontroli ekspresji. Oznacza to, że AI może czytać wykłady, artykuły czy komunikaty uczelniane z naturalnym, ludzkim zaangażowaniem, a nie mechanicznym tonem. Dla osób z dysfunkcjami wzroku lub dla tych, którzy wolą przyswajać wiedzę w biegu, to kamień milowy w dostępności edukacji.

Wyobraźmy sobie, że każdy skrypt na UEK ma swój przycisk „Posłuchaj”, który nie tylko czyta tekst, ale potrafi podkreślić głosem najważniejsze fragmenty (dzięki tagom ekspresji). Koszt takiego rozwiązania spadł drastycznie (do ok. 30 dolarów za milion znaków), co sprawia, że wdrożenie go na skalę całej uczelni jest realne i ekonomicznie uzasadnione. To również szansa na tworzenie interaktywnych materiałów audio, w których profesor może „rozmawiać” ze studentem poprzez personalizowanego awatara głosowego. Przyszłość nauki jest multimodalna, a Gemini 3.1 Flash TTS dostarcza nam właśnie niesamowitego instrumentu.

💰 3. Biznes, Ekonomia, Etyka i Prawo

Meta i Broadcom: Bitwa o krzem

W świecie wielkiego biznesu najgorętszą informacją tygodnia jest partnerstwo Mety (Marka Zuckerberga) z Broadcomem. Firmy te łączą siły, aby stworzyć własne, niestandardowe układy scalone (chips) nowej generacji, dedykowane wyłącznie pod AI. Dlaczego to ważne dla ekonomistów? Bo walka o dominację w AI to obecnie przede wszystkim walka o zasoby sprzętowe. Meta chce się uniezależnić od dostaw Nvidii, tworząc własne akceleratory, co może zatrząść całym rynkiem technologicznym i zmienić strukturę kosztów operacyjnych gigantów z Doliny Krzemowej.

Na UEK często analizujemy łańcuchy dostaw i monopole rynkowe. Ruch Mety to klasyczny przykład integracji pionowej. Przejmując kontrolę nad hardware’em, Zuckerberg zyskuje przewagę nie tylko w szybkości trenowania modeli, ale przede wszystkim w marży. Jeśli własne chipy okażą się wydajniejsze o 20-30%, Meta będzie mogła oferować swoje usługi AI taniej niż konkurencja, co wymusi agresywne obniżki cen u innych graczy. To doskonałe case study dla naszych studentów zarządzania strategicznego: jak walka o jeden komponent (krzem) determinuje sukces miliardowych platform software’owych.

EU AI Act a modele biomedyczne

Wprowadzenie GPT-Rosalind zbiega się w czasie z coraz ostrzejszą implementacją unijnego rozporządzenia o AI (EU AI Act). Modele o tak wysokiej specjalizacji i potencjalnym ryzyku (Dual-Use) będą musiały przejść rygorystyczne audyty bezpieczeństwa. Tu pojawia się konflikt interesów: z jednej strony chcemy szybkich innowacji medycznych, z drugiej – panicznie boimy się bioterroryzmu wspomaganego przez AI. Jak UEK pozycjonuje się w tej debacie? Wykładowcy prawa i etyki na naszej uczelni mają teraz pełne ręce roboty, analizując, jak polskie i unijne prawo zareaguje na model, który potrafi zaprojektować lek, ale i toksynę.

Musimy pamiętać, że regulacje to nie tylko zakazy, ale i standardy rynkowe. Uczelnie, które jako pierwsze opracują bezpieczne procedury współpracy z takimi modelami, staną się liderami komercjalizacji wyników badań. Biznes (zwłaszcza klastry life-science w Małopolsce) będzie szukał ekspertów, którzy potrafią nawigować w gąszczu przepisów EU AI Act, jednocześnie wyciskając z technologii maksimum wartości. To ogromna szansa dla naszych absolwentów na znalezienie wysokopłatnych nisz zawodowych na styku technologii, prawa i farmacji.

Etyka „Gated AI” – Czy wiedza powinna być zamknięta?

Wprowadzenie modeli takich jak GPT-Rosalind czy GPT-5.4-Cyber tylko dla „zaufanych” użytkowników otwiera puszkę Pandory w kwestii demokratyzacji AI. Jeśli tylko najbogatsze uniwersytety i największe korporacje będą miały dostęp do narzędzi „wyższej inteligencji”, przepaść między globalną północą a południem (oraz między gigantami a startupami) jeszcze się pogłębi. Czy wiedza ratująca życie (biotechnologia) powinna być przedmiotem korporacyjnej reglamentacji? To pytanie fundamentalne dla filozofii ekonomii, którą uprawiamy na naszej uczelni.

Z drugiej strony, całkowita otwartość w tych dziedzinach jest niebezpieczna. OpenAI próbuje znaleźć „trzecią drogę” – model nadzorowany. Jest to próba stworzenia odpowiedzialnej ekosfery technologicznej, w której wolność badań kończy się tam, gdzie zaczyna się zagrożenie dla bezpieczeństwa publicznego. Na UEK musimy uczyć studentów, że AI to nie tylko optymalizacja zysków, ale przede wszystkim potężna siła społeczna, która wymaga mądrego nadzoru i refleksji etycznej. Debata o „zamkniętych ogrodach” AI będzie jednym z głównych tematów nadchodzących lat.

📚 4. Przegląd Naukowy i Wydarzenia

Przełom w rozumowaniu agentycznym: Opus 4.7

W tym tygodniu Anthropic opublikował notatkę o nowej wersji swojego flagowego modelu: Claude Opus 4.7. Choć nie jest to nowa generacja (5.0), to zmiany w architekturze wewnętrznej przyniosły 10-15% wzrostu skuteczności w zadaniach agentycznych. Co to oznacza dla badacza? To oznacza, że model nie tylko odpowiada na pytania, ale potrafi samodzielnie planować wieloetapowe procesy, podejmować decyzje i poprawiać błędy w locie. Opus 4.7 wykazał się niesamowitą „szczerością” co do własnych ograniczeń, co jest kluczowe w pracy naukowej, gdzie halucynacje są niedopuszczalne.

Ciekawostką jest wynik na autorskim benchmarku Anthropic dotyczącym ostrości wizualnej. Nowy model osiągnął wynik 98.5% (w porównaniu do 54.5% wersji 4.6), co oznacza, że niemal bezbłędnie interpretuje skomplikowane diagramy, wykresy i schematy inżynieryjne. Dla naukowców z UEK analizujących dane wizualne, mapy przestrzenne czy historyczne dokumenty ekonomiczne, jest to zaproszenie do ponownego przetestowania możliwości Claude’a. Anthropic ogłosił jednocześnie plan wycofania starszych modeli (Sonnet 4 i Opus 4) do czerwca 2026, co wymusza na nas szybką migrację projektów badawczych na nowsze wersje.

ArXiv: Nowe paradygmaty wydajności

Wśród najnowszych publikacji na ArXiv (platformie z preprintami naukowymi) dominują prace nad efektywnością energetyczną modeli. Badacze coraz częściej zadają pytanie: jak osiągnąć inteligencję poziomu GPT-5, ale przy zużyciu energii mniejszym o 90%? Pojawiły się interesujące prace dotyczące „rzadkich” architektur (Sparsity), które aktywują tylko ułamek parametrów w odpowiedzi na konkretne zapytanie. To kluczowy temat dla UEK w kontekście zrównoważonego rozwoju (ESG) – ekologiczny koszt AI staje się równie ważny co jego skuteczność.

Innym trendem jest formalna weryfikacja systemów AI. Skoro model ma za nas programować (Codex), diagnozować (Rosalind) czy bronić sieci (Cyber-AI), musimy mieć matematyczną pewność, że nie popełni błędu w krytycznym momencie. Prace naukowe z tego tygodnia skupiają się na tworzeniu „bezpieczników” wbudowanych w samą architekturę sieci neuronowej. To fascynujący obszar dla naszych matematyków i statystyków: jak udowodnić poprawność czarnej skrzynki, jaką jest nowoczesne LLM?

Konferencje i GitHub: Open Source nie śpi

Na GitHubie w minionym tygodniu eksplodowała popularność repozytoriów związanych z autonomicznymi agentami badawczymi. Deweloperzy tworzą narzędzia, które potrafią samodzielnie przeszukiwać literaturę, syntezować wnioski i pisać wstępne wersje artykułów naukowych. Choć musimy podchodzić do tego z dystansem (ryzyko plagiatu i spadku jakości), nie możemy ignorować faktu, że warsztat pracy naukowca zmienia się na naszych oczach.

Wspólnota open-source odpowiedziała na nowości od Google i OpenAI własnymi modyfikacjami modeli lokalnych (np. Llama 4). Choć modele te są mniejsze, to dzięki technikom takim jak LoRA (Low-Rank Adaptation), można je wyspecjalizować do konkretnych zadań (np. analizy tekstów statutowych UEK) przy ułamku kosztów. To sygnał dla naszej uczelni, aby nie polegać wyłącznie na płatnych rozwiązaniach gigantów, ale budować własne kompetencje w zakresie wdrażania modeli otwartoźródłowych. To one dają pełną kontrolę nad danymi i suwerenność technologiczną.

🎯 5. Podsumowanie Tygodnia

Strategiczne wnioski dla społeczności UEK

Mijający tydzień udowodnił, że rok 2026 to rok hiper-specjalizacji. Modele ogólnego przeznaczenia stają się bazą (systemem operacyjnym), na której wyrastają potężne, branżowe narzędzia. Premiera GPT-Rosalind i GPT-5.4-Cyber to wyraźny sygnał: AI przestaje być zabawką do generowania obrazków z kotami, a staje się fundamentem biotechnologii i bezpieczeństwa państwowego. Dla nas, na Uniwersytecie Ekonomicznym w Krakowie, oznacza to, że musimy przestać pytać „czy AI wejdzie do naszej branży?”, a zacząć pytać „który wyspecjalizowany model zdefiniuje przyszłość moich finansów, marketingu czy zarządzania?”.

Drugim kluczowym trendem jest demokratyzacja poprzez integrację. Dzięki nowościom w Chrome i Gemini, AI staje się przezroczyste. Nie musimy już „wchodzić do AI” – ono jest wszędzie tam, gdzie mamy przeglądarkę i nasze dane. To ogromna szansa na zwiększenie produktywności administracyjnej i naukowej, ale też wyzwanie dla ochrony prywatności. Musimy być czujni i świadomi, gdzie kończy się nasze cyfrowe bezpieczeństwo, a zaczyna wygoda oferowana przez gigantów z Mountain View czy San Francisco.

Na koniec, warto śledzić ruchy sprzętowe Mety. Walka o chipy to nowoczesny wyścig zbrojeń. Jeśli UEK chce pozostać nowoczesną uczelnią, musi inwestować nie tylko w licencje na oprogramowanie, ale też w infrastrukturę (własną lub chmurową), która pozwoli nam na eksperymentowanie z tymi technologiami. AI News to nie tylko kronika wydarzeń – to drogowskaz dla naszych strategicznych decyzji inwestycyjnych i programowych. Testujmy, sprawdzajmy, bądźmy mądrzy i miejmy zdrowy dystans do huraoptymizmu, ale nie przegapmy momentu, w którym świat rusza gwałtownie do przodu.

🔗 6. Skarbnica Wiedzy

- OpenAI Rosalind – Oficjalna zapowiedź nowego modelu dedykowanego biologii i naukom o życiu. Przełom w badaniach genomicznych i proteinowych. LINK

- GPT-5.4-Cyber – Specjalistyczny wariant modelu OpenAI przeznaczony do defensywnego cyberbezpieczeństwa. Analiza binarna i wykrywanie luk. LINK

- Gemini 3.1 Flash TTS – Nowy standard generowania mowy od Google. Obsługa 70 języków i niesamowita kontrola ekspresji głosu lektora. LINK

- Claude Opus 4.7 – Najnowsza aktualizacja od Anthropic. Ogromny skok w zadaniach agentycznych i interpretacji wizualnej diagramów naukowych. LINK

- AI Mode w Chrome – Głęboka integracja AI z przeglądarką. Analiza wielu kart jednocześnie i wsparcie dla workflowów profesjonalistów. LINK

- Meta & Broadcom – Szczegóły strategicznego partnerstwa mającego na celu stworzenie własnych układów scalonych dla infrastruktury AI. LINK

- Nano Banana Personal Intelligence – Nowe funkcje prywatnej inteligencji w ekosystemie Google. Personalizacja bez utraty kontroli nad danymi. LINK

- Baza Danych ArXiv – Najnowsze preprinty naukowe z zakresu wydajności i etyki AI. LINK

📖 7. Bibliografia (APA 7)

Anthropic. (2026, April 14). Claude Opus 4.7: Advancing agentic workflows and visual reasoning. Anthropic News. https://anthropic.com/news/claude-opus-4-7

Google. (2026, April 15). Introducing Gemini 3.1 Flash TTS: High-fidelity speech generation at scale. Google Blog. https://blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-3-1-flash-tts/

Lohan, P. (2026, April 16). Google adds Nano Banana-powered image generation to Gemini’s Personal Intelligence. TechCrunch. https://techcrunch.com/2026/04/16/google-adds-nano-banana-powered-image-generation-to-geminis-personal-intelligence/

Meta Platforms. (2026, April 14). Meta partners with Broadcom to co-develop custom AI chips for next-generation infrastructure. CNBC Technology. https://cnbc.com/video/2026/04/14/meta-partners-with-broadcom-to-co-develop-custom-ai-chips.html

OpenAI. (2026, April 16). Introducing GPT-Rosalind: A frontier reasoning model for life sciences. OpenAI Blog. https://openai.com/index/introducing-gpt-rosalind/

The Hacker News. (2026, April 15). OpenAI unveils GPT-5.4-Cyber: An AI model for defensive cybersecurity. https://thehackernews.com/2026/04/openai-launches-gpt-54-cyber-with.html

🎙️ 8. Posłuchaj lub Obejrzyj

Interesujesz się zagadnieniami tego odcinka, a masz przed sobą zadanie, przy którym wolisz posłuchać głosu, czy zerknąć tylko kątem oka? Ożywiamy suche fakty! Skorzystaj z przygotowanych multimedialnych form podania treści.

Podsumowanie Audio

Wersja podcastowa dla słuchawkowców – dwóch hostów dyskutuje o tematach z artykułu…

Czas trwania: 32 min 45 sek.

Podsumowanie wideo

Filmik podsumowujący wizualnie treść artykułu z głosem lektora.

Prezentacja

Oglądnij w skondensowanej formie graficznej nowości opisane w artykule.

Po otwarciu PDF w aplikacji Adobe Reader naciśnij klawisze Ctr-L (tryb pełnoekranowy) i przechodź do kolejnych slajdów za pomocą strzałki w prawo.

Infografika

Wstawiona INFOgrafika z NotebookLM – podsumowani graficzne artykułu.

Uwaga

Badanie: 17 kwietnia 2026

Gemini, NotebookLM, AIstudio, Antigravity.

Grafiki: Google nanobanana