AI News dla UEK (Tydzień #12): Gemini, Claude Code i Mistral Voxtral

⚡ Szybki Przegląd tygodnia:

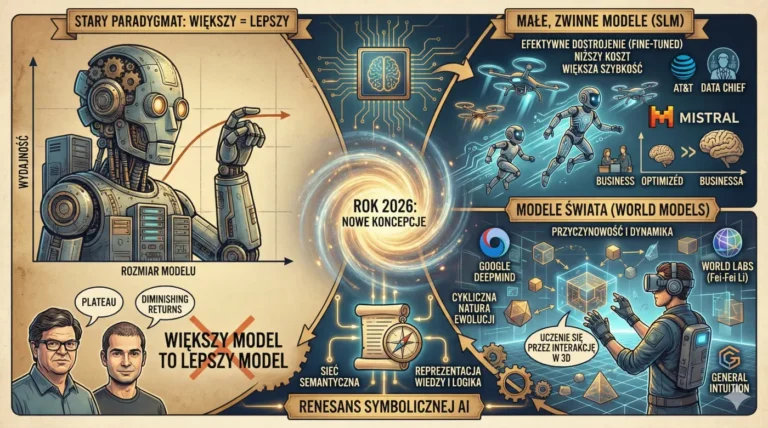

Miniony tydzień (21-27 marca 2026) charakteryzował się niespotykaną wręcz intensywnością premier i ogłoszeń w segmencie sztucznej inteligencji, z wyraźnym naciskiem na autonomię systemów, rozwój modeli lokalnych oraz wdrażanie mechanizmów zabezpieczających i wykrywających generowane treści. Najwięksi gracze rynkowi, tacy jak Google i Anthropic, po raz kolejny przesunęli granice tego, w jaki sposób wchodzimy w interakcję z komputerami. Zaprezentowano rozwiązania, które w niedalekiej przyszłości fundamentalnie przekształcą zarówno procesy analityczne w biznesie, jak i organizację pracy w instytucjach edukacyjnych. Szczególne znaczenie dla akademii będą miały premiery modeli typu open-source, które obniżają barierę wejścia dla środowisk naukowych.

Google ogłosiło potężne pakiety aktualizacji, które wzmacniają ekosystem Gemini. Flagową zmianą jest wdrożenie funkcji przenoszenia całej historii konwersacji z innych narzędzi AI do Gemini oraz udostępnienie modułu „Personal Intelligence” w darmowych planach na terytorium USA. Oznacza to głębszą integrację wirtualnego asystenta z prywatnymi danymi z poczty Gmail czy chmury Google Photos. To ogromny krok w kierunku stworzenia „asystenta ostatecznego”, który nie tylko odpowiada na pytania, ale doskonale „zna” kontekst życiowy i zawodowy użytkownika. Dla sektora edukacji, a szczególnie dla instytucji zintegrowanych z platformami Google Workspace, może to zwiastować nadchodzącą ewolucję środowiska chmurowego z typowego schowka na pliki do roli aktywnego asystenta dydaktycznego i analitycznego. Podobne kroki stawiają europejskie organizacje dążące do zwiększenia personalizacji uczenia maszynowego.

Nie mniejszym echem odbiła się premiera najnowszego dziecka Anthropic. „Claude Code” wkroczył w fazę research preview, otwierając zupełnie nowy rozdział interfejsów opartych na agentach AI. Claude Code potrafi samodzielnie wchodzić w interakcję z systemem macOS, klikając, wpisując tekst i otwierając lokalne aplikacje. Do tego dochodzą najświeższe innowacje open-source – francuska firma Mistral uruchomiła Voxtral, otwarty model syntezy mowy z kontrolą emocjonalną. Dodając do tego najnowszy Spam Update Google ukierunkowany na eliminowanie nadużyć przy tworzeniu masowych tekstów przez AI, otrzymujemy obraz niezwykle dynamicznego ekosystemu, który na naszych oczach normalizuje użycie autonomicznych asystentów, zarazem wyposarzając wyszukiwarki w lepszy oręż do odsiewania informacji nienaturalnych. Z punktu widzenia uczelni wyższych otwiera to drogę do wnikliwych badań nad polityką bezpieczeństwa informacji oraz procedurami transparentności w dobie narzędzi wieloagentowych.

🚀 1. Radar Technologiczny

Radar technologiczny na koniec marca 2026 roku zdominowany został przez dwie strategiczne platformy, które coraz odważniej pozycjonują swoje flagowe modele jako uniwersalne środowiska wykonawcze dla agentów AI. Pierwszym bohaterem jest „Claude Code” zaprezentowany przez Anthropic. Premiera ta, która miała miejsce 23 marca, przenosi model Claude z okna przeglądarki prosto w środowisko lokalnego menedżera okien. Jako wczesna wersja badawcza, Claude Code zyskał bezprecedensową umiejętność manipulowania graficznym interfejsem systemu macOS. AI może teraz nawigować po ekranie czytać jego zawartość i symulować interakcję za pomocą wpisywania klawiatury oraz kliknięć. Jest to zmiana o ogromnym znaczeniu technologicznym – maszyny przestają jedynie generować treści na żądanie, a zaczynają zachowywać się jako samodzielni wirtualni pracownicy (Digital Workers), którzy mogą obsługiwać aplikacje zewnętrzne niewyposażone w natywne API. W środowisku akademickim taki agent wkrótce może być w stanie masowo obsługiwać systemy typu USOS i wykonywać zrutynizowane działania wprowadzania stopni oraz przepisywania ankiet, drastycznie zmniejszając narzut administracyjny. Rodzi to rzecz jasna olbrzymie pytania o kwestie zabezpieczeń (tzw. „jailbreak”, w którym atakujący nakazuje modelowi złośliwą akcję na systemie hosta).

Kolejny przełom techniczny na naszym radarze to najnowsza premiera od firmy Mistral. W tym przypadku mowa o Voxtral (zadebiutował 26 marca 2026) – innowacyjnym modelu głosowym działającym na licencji otwartej (open-weights). Voxtral reprezentuje nową architekturę text-to-speech (TTS), która kładzie ogromny nacisk na możliwości kontrolowania tempa, precyzyjnej barwy i przede wszystkim zabarwienia emocjonalnego generowanego sygnału audio. Co fundamentalne dla badaczy i entuzjastów AI, Mistral udostępnił narzędzie w formie publicznej bezpośrednio na platformie Hugging Face. Optymalizacja Voxtrala pozwala na płynne działanie na relatywnie zwyczajnym konsumenckim sprzęcie lub typowych zestawach GPU dostępnych na uniwersytetach. Model ten poszerza horyzonty w obszarze inżynierii obsługi klienta i tworzenia wirtualnych lektorów wielojęzycznych, ponieważ naturalność brzemienia i przejścia między intonacjami stoją tutaj na bezprecedensowym dla domeny otwartej poziomie. W rękach studentów Data Science i programistów model staje się wybitnym środowiskiem testowym do integracji głosowej sztucznej inteligencji, choć pociąga za sobą spore implikacje etyczne w kontekście łatwego generowania treści mogących podszywać się pod inną tożsamość.

Ostatnim wielkim ruchem jest taktyczna odpowiedź Google. Gigant z Mountain View wdraża szerokie aktualizacje wyszukiwarki (Core Update oraz Spam Update) w dniach 24-27 marca, które według analiz rynkowych bezpośrednio implementują wyrafinowane filtry semantyczne, przypuszczalnie napędzane modelami klasy Gemini 4.0. Zamiast wykrywania typowych fraz, narzędzia te na niespotykaną wcześniej skalę potrafią odróżniać masowo powielane, sztucznie produkowane teksty typu „SEO spam” od merytorycznego contentu pochodzącego od doświadczonych naukowców czy badaczy. Równocześnie w samej aplikacji Gemini wprowadzono rewolucyjną możliwość bezproblemowej migracji historii rozmów z innych platform. Ten „AI-Interoperability Update” nie jest tylko miłym dodatkiem dla użytkowników, ale pierwszym historycznym dowodem na to, iż wirtualne „Pamięci” konwersacji stają się cennym nośnikiem danych i tożsamości, o który biją się tytani branży. Równocześnie darmowe uwolnienie narzędzi Personal Intelligence w obrębie kont Google obwieszcza początek ery, gdzie nasza infrastruktura cyfrowa jest trwale monitorowana i analizowana przez modele dla naszego osobistego i organizacyjnego dobra. Z punktu widzenia archiwizacji edukacyjnej to krok milowy ku bezszwowym ekosystemom analizy notatek akademickich.

🎓 2. Akademia i Administracja w Praktyce

Szczególne wyzwania współczesnych uniwersytetów znajdują coraz śmielsze odpowiedzi w ewolucji technologii AI. Zaczynając od rewolucyjnego uwalniania modułów takich jak „Personal Intelligence” przez firmę Google, należy wziąć pod uwagę wielorakie implikacje tych nowości dla sektora akademickiego. Możliwość, w której asystent oparty na modelu Gemini automatycznie łączy informacje pozyskane z wiadomości mailowych wykładowcy, wpisów z jego dysku strumieniowego i kalendarzy akademickich, rodzi olbrzymią optymalizację zarządczą. Wykładowcy Uniwersytetu Ekonomicznego w Krakowie, którzy na co dzień zmagają się z dziesiątkami zawiadomień, recenzji oraz pytań studenckich, zyskują potencjał do stworzenia wirtualnej „pierwszej linii wsparcia”. Taki system mógłby w pełni zrozumieć kontekst pytania („Proszę o przedłużenie terminu testu w oparciu o regulamin kursu”) i zasugerować natychmiastową, zindywidualizowaną odpowiedź z uwzględnieniem kalendarza, regulaminu i poprzednich konwersacji z konkretnym studentem, uwalniając gigantyczną pulę godzin z harmonogramów pracy akademików. Rozwiązania zaprezentowane końcem marca dają jasny sygnał, że zintegrowany profil asystenta „uczącego się uczelni” i jej obiegu dokumentów staje się normą.

Natomiast pojawienie się otwartego modelu Mistral Voxtral rzuca zupełnie nowe światło na dystrybucję wiedzy na platformach e-learningowych. Aktualnym problemem wielu szkoleń zdalnych i webinariów jest brak angażującego prelegenta lub niedobór funduszy na profesjonalne studio nagraniowe. Otwarte modele zamieniające merytoryczny tekst dydaktyczny w pełną emocji, poprawnej dykcji i uwiarygodnioną brzmieniowo wypowiedź wykładowcy generują wprost niewyobrażalną wartość dla kształcenia asynchronicznego. Profesorowie mogliby produkować materiały edukacyjne znacznie szybciej, dostarczając zaledwie zredagowaną transkrypcję wykładu do modelu, który następnie odegra rolę cyfrowego awatara dydaktycznego, automatycznie urozmaicając materiał o pauzy myślowe, pytania retoryczne (intonacja) i zmiany ekspresji głosowej odpowiednie dla kontekstu materiału z obszaru finansów czy zarządzania. Co więcej, Mistral chwali się wsparciem dla ujęć multilingwalnych, dlatego tworzenie kursów dla studentów na wymianie międzynarodowej z programu Erasmus w ich natywnych narzeczach, lub w idealnej translacji na angielski na podstawie oryginalnego tekstu wykładowcy, nie byłoby już absolutnie żadną barierą. Przynosi to obietnicę wyrównywania szans edukacyjnych.

Jednakże wraz ze wspaniałymi innowacjami oprogramowania „Digital Worker”, takimi jak narzędzia UI od firmy Anthropic, administracja uniwersytecka (oraz laboratoria UEK) stoją na krawędzi całkowitej redefinicji swoich procesów cyfrowych. Jeżeli program typu Claude Code zostanie dopuszczony do obsługiwania systemów finansowych czy obsługi rekrutacji na uczelni, konieczne stanie się wdrożenie procedur z obszaru tzw. Robotic Process Automation 2.0 (RPA napędzanego agentami AI). W przeciwieństwie do starych skryptów klikających po ustalonym oknie, system potrafi sam analizować strukturę strony przy użyciu widzeń komputerowych. To budzi pilną potrzebę opracowania przez działy IT Uniwersytetu ścisłych standardów dostępu do środowiska komputerowego oraz certyfikacji agentów w środowiskach pracy chroniącej dane wrażliwe. Uniwersytet zmierza powoli z modelu korzystania z ChatBOT’ów zewnętrznych (które nie miały głębokiego dostępu do infrastruktury lokalnej) ku hybrydowym formom asystentów biurowych mających realny „dotyk” systemu plikowego instytucji edukacyjnej, co wymusza budowę specjalistycznego podejścia w szkoleniach administracji, nie omijając oczywiście wykładowców tworzących syllabusy na nowe sezony rekrutacyjne i edukacyjne.

💰 3. Biznes, Ekonomia, Etyka i Prawo

Europejski rynek technologii i prawa pozostaje w epicentrum działań standaryzacyjnych dotyczących zarządzania potęgą Sztucznej Inteligencji. Miesiąc marzec 2026 i bieżący tydzień obserwacji potwierdzają kluczowy etap wdrażania założeń EU AI Act. W tle globalnych premier, takich jak modele głosowe i skrypty agentów macOS od Anthropic, instytucje europejskie i polska gospodarka przyspieszają procedury mianowania wertykalnych ciał nadzoru i tzw. punktów kontroli ds. AI. Jak precyzuje European Parliamentary Research Service (EPRS) w swoim ogłoszeniu marcowym, kraje członkowskie (w tym Polska) objęte są obowiązkiem skrupulatnego formowania autorytetów rynku nadzorowania produktów algorytmicznych. Choć obecnie wciąż widoczny jest chaos operacyjny z racji niewielkiej ilości mianowanych „urzędów” w całej Unii Europejskiej, implikuje to narastające napięcie dla każdego podmiotu akademickiego i komercyjnego. Dla studentów informatyki, startupów wywodzących się z UEK czy firm wdrażających rozwiązania typu Mistral (które same w sobie wpisują się teraz w wytyczne transparentności open-source’owej), lada moment pojawi się konieczność kłaniania się przed niezwykle trudnymi regułami oceny wpływu „High-Risk AI Systems”. Zmiany regulacyjne tworzą lukratywne zapotrzebowanie na prawników technologicznych z zacięciem zarządczym na szczeblu corporate compliance.

Jednym z najbardziej krytycznych elementów, który objawił się w tym tygodniu na stykach biznesu technologicznego z etyką, jest włączona w dniach 24-27 marca potężna operacja wyszukiwarki Google znana jako „Spam Update”. Powszechnie branża cyfrowa spekuluje, że firma odpaliła algorytmy ukierunkowane strikte na precyzyjną weryfikację tekstów wyplutych w całości przez generatywne silniki sztucznej inteligencji. Wymiar biznesowy tego update’u może być druzgocący dla internetowych przedsiębiorców masowo żerujących na darmowej syntezie słów kluczowych do nędznego zarabiania na pozycjonowaniu w sieci. Oczyszczanie organicznych stron ma doprowadzić do radykalnej zmiany paradygmatów widoczności firm w Internecie. Google wyraża w ten sposób jasną moralną wizję – nagradzana ma być głęboka „doświadczeniowa” twórczość oraz precyzyjne dziennikarstwo eksperckie, a potępiane automatycznie mielone strony MFA (Made For Advertising). Oznacza to, że wiedza o funkcjonowaniu algorytmicznych „Strażników” stanowi dziś potężny argument analityczny. Wydarzenie to jest żywym dowodem powracającej do sfery biznesowej premii za autentyczność, na czym bezpośrednio mogą zyskać uniwersytety oparte o solidne bazy naukowe, których treść obroni się w konfrontacji z detektorami. Reputacja badawcza staje się najdroższą walutą nowej gospodarki opartej na danych.

Polski wymiar implementacji prawnych i inwestycji jest równie głośny. Wspierając się ogólnodostępnymi uaktualnieniami rynkowymi opublikowanymi przez międzynarodowych obserwatorów, dowiadujemy się o twardych celach tworzenia lokalnych tak zwanych „AI Factories” oraz poligonów testowych – sandboksów do audytowania ryzyk implementacji sztucznej inteligencji, w tym dla obszarów medycznych, logistycznych oraz rolniczych. Zapowiedziany na przestrzeni 2026 i 2027 cykl dotacji kreśli wizję Polski, jako kluczowego integratora i poligonu doświadczalnego w ramach Wspólnego Rynku dla systemów klasyfikowanych przez AI Act. Tym samym uczelnie posiadające certyfikowane kierunki związane ze sztuczną inteligencją lub administracją publiczną – jak Uniwersytet Ekonomiczny w Krakowie – stają niemal na przymusowej ścieżce pionierów kształtujących nowe zasady komercyjnego i społecznego wykorzystania potężnych narzędzi cyfrowych z szanowaniem prywatności obywateli. Wszelkie kroki czynione obecnie w kierunku formowania audytorów algorytmicznych stanowią najlepszą formę „lewarowania” przyszłych zysków gospodarczych dla ambitnych absolwentów szkół wyższych na trudnym rynku pracy jutra. Z całą pewnością innowacje głosowe (Mistral) oraz głębokie agentowe systemy macOS (Anthropic Claude Code) znajdą się bardzo szybko na celownikach analityków z punktu widzenia ewentualnych nadużyć tożsamości w Polsce i Europie Zachodniej.

📚 4. Przegląd Naukowy i Wydarzenia

Bieżący tydzień dostarczył środowisku naukowemu niezwykle żyznych i intrygujących przypadków, mogących stać się podstawą do wysoce wyspecjalizowanych prac licencjackich i magisterskich. Jako fundament na pierwszym miejscu ląduje sam postulat, iż interakcja maszyna-człowiek weszła na teren bezpośredniej kontroli maszyn. Zaprezentowane badania (w tym udostępniony kod badawczy) związane z wdrożeniem przez Anthropic modelu w interfejs graficzny macOS (Graphic User Interface Automation) stawiają niesamowite pytania naukom kognitywnym oraz ergonomistom. Środowisko naukowe, które dotychczas zachwalało czatowe interfejsy i uważało je za relatywnie bezpieczny margines wymiany poglądów, musi dzisiaj zrewidować procesy autorytyzacji. Głośne dyskusje wokół tak zwanego zagadnienia „Agentic Alignment” (równania kierunków celów autonomicznych agencji cyfrowych) obracają się w środowisku uniwersyteckim we wiodący temat na wydziałach zarządzania i informatyki. Problem tworzenia piaskownic z pełnoprawną izolacją (sandboxing), w którym uruchomiony przez studenta na uniwersyteckim sprzęcie asystent AI nie mógłby wykorzystać uzyskanych podpowiedzi w cyberprzestępczy sposób, dominuje inżynierię oprogramowania na wyższych uczelniach i stanowi wyraz palącej potrzeby opracowywania bezpiecznych ram koncepcyjnych ochrony kampusów edukacyjnych w dobie generatywnego AI.

Na arenie naukowej związanej z NLP, inżynierią fal dźwiękowych i lingwistyką algorytmiczną równie wirtuozerski debiut zaliczył Voxtral, opracowany przez wybitnych inżynierów z europejskiego laboratorium Mistral. Otrzymując powszechny dostęp poprzez platformę Hugging Face, tysiące uniwersyteckich deweloperów po raz pierwszy w tak wielkiej skali na kontynencie mają prawo eksperymentować z siecią typu open-weights modelującą surowy dźwięk ze wszytym poczuciem akcentuacji słownej. Otwiera to wybitne możliwości badawcze dla Zakładów Językoznawstwa czy instytutów Filologii w kooperacji z kierunkami analitycznymi. Kwestia transferu niuansów emocjonalnych czy regionalizmów mowy w środowisku uniwersalnych sieci neuronowych bywa bardzo zniekształcona ze względu na globalistyczny charakter modeli trenowanych głównie w USA. Obecna walka francuskich pionierów to rzucenie wprost epokowego wyzwania dominacji anglosaskiej i podwaliny pod powstawanie systemów zachowujących polskie tradycje fonetyczne na tle cyfryzacji z poszanowaniem wielojęzyczności państw europejskich w duchu otwartej kooperacji badawczej i integracji międzyuniwersyteckiej. Prowadzenie badań porównawczych modeli Voxtral a dawnych TTS ze stajni innych wytwórni wydaje się znakomitą inwestycją czasu na uczelniach w bieżącym okresie.

Dodatkowo, obserwowany proces implementacji technologii „Personal Intelligence”, udomowionych przez globalnych potentatów jak Google, podnosi znaczącą debatę na szczeblu metodologicznym o charakterze filozofii danych i etyki nauki. Dotychczas środowiska naukowe tworzyły abstrakcyjne byty algorytmiczne stacjonujące z dala od ustrukturyzowanych wspomnień poszczególnych cywilów. Dziś integracja baz i osobistej inteligencji wymusza powstawanie dziedzin wiedzy związanych z ochroną tajemnicy personalnej wobec komercyjnych „lustrzanych odbić” (digital twins) asystentów biurowców amerykańskich korporacji. Polscy badacze, stojący na progu ogłoszonych celów formowania „AI Factories”, uczestniczą równocześnie w kreowaniu podwalin prawnych z regulatorem rządowym, dążąc do tworzenia krajowych chmur obliczeniowych tak, aby chronić wyrafinowany kod uniwersyteckich laboratoriów. Obserwowane w Europie wytyczne co do ujawniania pochodzenia generowanych zrzutów oraz zabezpieczania mechaniki wytyczają drogowskaz w nadchodzących wczesnowiosennych sesjach wewnątrzśrodowiskowych, ukierunkowanych na tworzenie silnej cyfrowo administracji opierającej się presjom monopolistów rynkowych, ze starannym zachowaniem suwerenności własnej wiedzy i lokalnej kultury prawnej uniwersytetów.

🎯 5. Podsumowanie Tygodnia

Podsumowując czwarty tydzień marca 2026 roku – stał się on poligonem fundamentalnej przemiany jakościowej na rynku narzędzi generatywnych i infrastrukturalnych, obwieszczając erę interakcji zaawansowanej o krok dalej od trybu tekstowych okienek. Dopuszczenie przez programistów instancji takich jak Claude Code do operowania w grafólnym zarządzaniu systemami oraz wdrożenie przez gigantów kalibru Google modeli zintegrowanych w pełen, wszechogarniający ekosystem chmurowy poprzez darmowy moduł Personal Intelligence wyznacza twardy trend unifikacji naszych stacji pracy i udomawia wirtualnych doradców na stałe. Uczelniane zespoły badawcze nie mogą już biernie przyglądać się postępującym potęgom systemów zamkniętych, czego optymistycznym zwrotem akcentowanej transformacji stają się działania pro-open source ze strony Mistral. Model Voxtral budzący symulowane zachowania emocyjne podczas generowania dźwięku jest dobitnym świadectwem tego, w jaki sposób zredukowany wysiłek oddolnego wdrożenia rewolucjonizuje sektor narzędzi analityczno-lingwistycznych dostępnych „na własnym podwórku”, omijając drogie i pilnie obserwowane licencje i tak już przejawiając fenomenalny impakt z uwagi na europejskie wykształcenie sieci w ramach otwartych standardów Hugging Face. Zjawiska te stanowią punkt odniesienia do poważnych modyfikacji procedur bezpieczeństwa na wyższych uczelniach badawczych na całym kontynencie.

Nade wszystko, tegoroczna wiosna obfituje w rosnące presję regulacyjną ze strony struktur UE. Nowa filozofia wyszukiwarek celująca w masowych „puste” teksty sygnalizuje rynkowe dążenie do premiowane wiedzy akademickiej i profesjonalnego dyskursu w starciu z spamem wspomaganym przez silniki generujące. Implementacja wymagań podyktowanych w zapisach prawnych będzie niezwykle rygorystycznym testem, po którym wkraczamy w erę „Legal AI” – gdzie umiejętność tworzenia zgodnych z wymogami, oznaczonych i transparentnych narzędzi do wspierania edukacji przesunięta zostanie w pierwszej kolejności na prawników oraz informatyków tworzących algorytmy i sandboxy. Inicjatywy kreowane centralnie – takie jak wyznaczanie państwowych urzędów czy narodowe strategie budowy „AI Factories” – w Polsce – czynią otoczenie krajowe świetnym terenem dla nowych wdrożeniowych biznesów i start-up’ów wywodzących swoich pionierów prosto z sal krakowskiego Uniwersytetu Ekonomicznego. W środowiskach akademickich, to z pewnością będzie sezon podniesionej uwagi przed ostatecznym osadzeniem prawodawstwa, z nadzieją uregulowania cyfrowego dzikiego zachodu.

🔗 6. Skarbnica Wiedzy

- – Uwolnienie aktualizacji do Google Gemini App oraz Personal Intelligence dla USA – ważny krok w integracji prywatnych informacji z ekosystemem sztucznej intleigencji.

- – Raport wdrażania mechanizmów wykrywania spamu Google Core Update – AI Detection – nieodwracalne zmiany w organicznych zestawieniach ukierunkowane by karać bezwartościowy spam AI, w oparciu o filtry semantyczne.

- – Zapowiedź Claude Code – wejście agentów na komputery lokalne – ewolucja asystenta do pełnoprawnego modułu zdolnego manipulować interfejsem graficznym komputera osobistego i okienkami MacOS bez dedykowanych API.

- – Premiera darmowego silnika otwartego Voxtral od Mistrala pod asystentów głosowych – znakomita baza tekst-to-speech stworzona z myślą o społeczności programistów akademickich dbająca o warstwę spersonalizowanych emocji.

- – Unijny krajobraz powołania organów nadzoru sztucznej inteligencji AI Act EU w państwach członkowskich – najnowsze materiały ukazujące potężną machinę biurokratyczną stojącą przed Polską wdrażającą ramy odpowiedzialności dla produktów bazowych (kwartał I 2026).

📖 7. Bibliografia (APA 7)

- – Anthropic. (2026, marzec 23). Anthropic March 2026 Roundup – Claude Code Preview. [TheNewStack.io]. Pozyskano z: https://thenewstack.io/anthropic-march-2026-roundup/

- – BARR Advisory. (2026, marzec). EU AI Act: Responsibilities for Businesses Using AI Agents in 2026. [Barr Advisory Resource]. Pozyskano z: https://barradvisory.com/resource/eu-ai-act-2026/

- – ClickRank. (2026, marzec 27). Google March 2026 Core Update & Spam Filters. [ClickRank.ai]. Pozyskano z: https://clickrank.ai/google-march-2026-core-update/

- – Google The Keyword. (2026, marzec 27). Gemini App Updates: Cross-provider History and Personal Intelligence Free. [Google Blog]. Pozyskano z: https://blog.google/innovation-and-ai/products/gemini-app/gemini-drop-updates-march-2026/

- – TechCrunch. (2026, marzec 26). Mistral releases a new open-source model 'Voxtral’ for speech generation. [TechCrunch]. Pozyskano z: https://techcrunch.com/2026/03/26/mistral-releases-a-new-open-source-model-for-speech-generation/